ChatGPT dengan cepat menjadi kesayangan AI generatif, tetapi itu bukan satu-satunya pemain dalam game. Sebagai tambahan semua alat AI lainnya di luar sana yang melakukan hal-hal seperti pembuatan gambar, ada juga sejumlah pesaing langsung dengan ChatGPT — atau begitulah yang saya duga.

Isi

- Bing oleh Microsoft

- BERT oleh Google

- Meena oleh Google

- Roberta oleh Facebook

- XLNet oleh Google

- DialogGPT oleh Microsoft Research

- ALBERT oleh Google

- T5 oleh Google

- CTRL oleh Salesforce

- GShard oleh Google

- Blender oleh Riset AI Facebook

- Pegasus oleh Google

Mengapa tidak menanyakannya kepada ChatGPT? Itulah yang saya lakukan untuk mendapatkan daftar ini, berharap menemukan beberapa opsi untuk itu menghadapi pemberitahuan "pada kapasitas"., atau orang lain yang hanya ingin mencoba sesuatu yang baru. Tidak semua ini dapat diakses publik seperti ChatGPT, tetapi menurut ChatGPT, ini adalah alternatif terbaik.

Video yang Direkomendasikan

Bing oleh Microsoft

Sebelum masuk ke pilihan yang dicantumkan oleh AI, alternatif terbaik untuk ChatGPT adalah, ChatGPT. Microsoft baru-baru ini

menambahkan AI ke mesin pencari Bing-nya, dan berencana untuk segera meluncurkan fitur tersebut ke browser Edge.Terkait

- Pembuat ChatGPT OpenAI menghadapi penyelidikan FTC atas undang-undang perlindungan konsumen

- Rekor pertumbuhan ChatGPT baru saja dicopot oleh aplikasi viral baru

- OpenAI membangun tim baru untuk menghentikan AI superintelligent menjadi nakal

Ini hanya dalam pratinjau, tetapi Anda masih dapat mencoba chatbot AI baru di bing.com/baru sekarang. Microsoft mengatakan awalnya membatasi jumlah kueri, tetapi Anda bisa bergabunglah dengan daftar tunggu Bing ChatGPT untuk diberitahu ketika versi lengkap tersedia.

BERT oleh Google

BERT (Bidirectional Encoder Representations from Transformers) adalah model pembelajaran mesin yang dikembangkan oleh Google. Banyak hasil ChatGPT menyebutkan proyek oleh Google, yang akan Anda lihat nanti di daftar ini.

BERT dikenal dengan kemampuan pemrosesan bahasa alami (NLP), seperti menjawab pertanyaan dan analisis sentimen. Ini menggunakan BookCorpus dan Wikipedia bahasa Inggris sebagai modelnya untuk referensi prapelatihan, setelah mempelajari masing-masing 800 juta dan 2,5 miliar kata.

BERT pertama kali diumumkan sebagai proyek penelitian sumber terbuka Dan makalah akademik pada Oktober 2018. Teknologi tersebut telah diterapkan ke dalam Google Penelusuran. Sastra awal tentang BERT membandingkannya dengan ChatGPT OpenAI pada November 2018, mencatat bahwa teknologi Google adalah dua arah yang dalam, yang membantu memprediksi teks yang masuk. Sedangkan OpenAI GPT bersifat unidirectional dan hanya dapat merespon query yang kompleks.

Meena oleh Google

Meena adalah chatbot itu Google memperkenalkan pada Januari 2020 dengan kemampuan untuk berkomunikasi dengan cara yang mirip manusia. Contoh fungsinya termasuk percakapan sederhana yang menyertakan lelucon dan permainan kata yang menarik, seperti Meena yang menyarankan sapi mempelajari "ilmu Bovine" di Harvard.

Sebagai alternatif langsung dari GPT-2 OpenAI, Meena memiliki kemampuan untuk memproses data 8,5 kali lebih banyak dari pesaingnya saat itu. Jaringan sarafnya terdiri dari 2,6 parameter dan dilatih pada percakapan media sosial domain publik. Meena juga menerima skor metrik dalam Sensibleness and Specificity Average (SSA) sebesar 79%, menjadikannya salah satu chatbot paling cerdas pada masanya.

Kode Meena tersedia di GitHub.

Roberta oleh Facebook

RobertTa (Pendekatan Pretraining BERT yang Dioptimalkan dengan Kuat) adalah versi lanjutan lain dari BERT asli, yang Facebook mengumumkan pada Juli 2019.

Facebook membuat model NLP ini dengan sumber data yang lebih besar sebagai model prapelatihannya. RoBERTa menggunakan CommonCrawl (CC-News), yang mencakup 63 juta artikel berita berbahasa Inggris yang dihasilkan antara September 2016 dan Februari 2019, sebagai kumpulan data 76 GB. Sebagai perbandingan, BERT asli menggunakan 16GB data antara Wikipedia bahasa Inggris dan kumpulan data BookCorpus, menurut Facebook.

Mirip dengan XLNet, RoberTa mengalahkan BERT dalam satu set kumpulan data benchmark, sesuai penelitian Facebook. Untuk mendapatkan hasil ini, perusahaan tidak hanya menggunakan sumber data yang lebih besar tetapi juga melatih modelnya untuk a periode waktu yang lebih lama.

Facebook membuat Roberta open-source pada September 2019, dan kodenya adalah tersedia di GitHub untuk eksperimen komunitas.

VentureBeat juga menyebutkan GPT-2 di antara sistem AI yang muncul selama waktu itu.

XLNet oleh Google

XLNET adalah model bahasa autoregresif berbasis transformator yang dikembangkan oleh tim dari Peneliti Google Brain dan Universitas Carnegie Mellon. Model ini pada dasarnya adalah BERT yang lebih canggih dan pertama kali dipamerkan pada Juni 2019. Grup menemukan XLNet setidaknya 16% lebih efisien dari BERT asli, yang diumumkan pada tahun 2018, yang mampu mengalahkan BERT dalam pengujian 20 tugas NLP.

XLNet: metode prapelatihan baru untuk NLP yang secara signifikan meningkatkan BERT pada 20 tugas (mis., SQuAD, GLUE, RACE)

arxiv: https://t.co/C1tFMwZvyW

github (kode + model terlatih): https://t.co/kI4jsVzT1u

dengan Zhilin Yang, @ZihangDai, Yiming Yang, Jaime Carbonel, @rsalakhupic.twitter.com/JboOekUVPQ

— Quoc Le (@quocleix) 20 Juni 2019

Dengan XLNet dan BERT yang menggunakan token “bertopeng” untuk memprediksi teks tersembunyi, XLNet meningkatkan efisiensi dengan mempercepat bagian prediktif dari proses tersebut. Misalnya, Amazon Alexa ilmuwan data Aishwarya Srinivasan dijelaskan bahwa XLNet dapat mengidentifikasi kata "Baru" yang diasosiasikan dengan istilah "is a city" sebelum memprediksi istilah "York" yang juga diasosiasikan dengan istilah tersebut. Sementara itu, BERT perlu mengidentifikasi kata “New” dan “York” secara terpisah lalu mengaitkannya dengan istilah “is a city”, misalnya.

Khususnya, GPT dan GPT-2 juga disebutkan dalam penjelasan ini dari 2019 sebagai contoh lain dari model bahasa autoregresif.

Kode XLNet dan model pra-pelatihan adalah tersedia di GitHub. Model ini terkenal di kalangan komunitas riset NLP.

DialogGPT oleh Microsoft Research

DialogGPT (Dialogue Generative Pre-trained Transformer) adalah model bahasa autoregresif yang diperkenalkan pada November 2019 oleh Microsoft Research. Dengan kemiripan dengan GPT-2, model ini dilatih sebelumnya untuk menghasilkan percakapan seperti manusia. Namun, sumber informasi utamanya adalah 147 juta dialog multi-putaran yang diambil dari utas Reddit.

Kepala penginjil HumanFirst Cobus Greyling telah mencatat keberhasilannya dalam mengimplementasikan DialogPT ke dalam layanan perpesanan Telegram untuk menghidupkan model tersebut sebagai chatbot. Dia menambahkan bahwa menggunakan Amazon Web Services dan Amazon SageMaker dapat membantu menyempurnakan kode.

Kode DialogPT tersedia di GitHub.

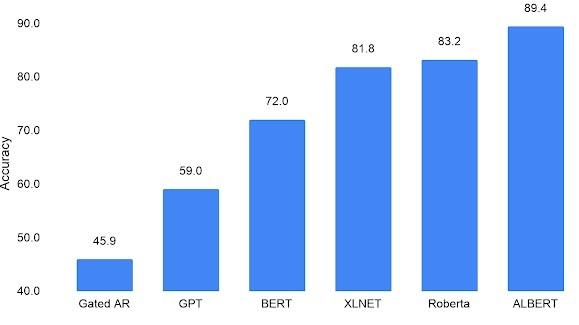

ALBERT oleh Google

ALBERT (BERT Ringan) adalah versi terpotong dari BERT asli dan dikembangkan oleh Google pada Desember 2019.

Dengan ALBERT, Google membatasi jumlah parameter yang diizinkan dalam model dengan memperkenalkan parameter dengan "penyematan lapisan tersembunyi".

Hal ini meningkat tidak hanya pada model BERT tetapi juga pada XLNet dan RoBERTa karena ALBERT dapat dilatih kumpulan informasi data yang lebih besar yang sama digunakan untuk dua model yang lebih baru sambil mengikuti yang lebih kecil parameter. Pada dasarnya, ALBERT hanya bekerja dengan parameter yang diperlukan untuk fungsinya, yang meningkatkan kinerja dan akurasi. Google merinci bahwa mereka menemukan ALBERT melebihi BERT pada 12 tolok ukur NLP, termasuk tolok ukur pemahaman bacaan seperti SAT.

Meskipun tidak disebutkan namanya, GPT disertakan dalam pencitraan ALBERT di blog Google Research.

Google merilis ALBERT sebagai sumber terbuka pada Januari 2020, dan diterapkan di atas TensorFlow Google. Kode tersedia di GitHub.

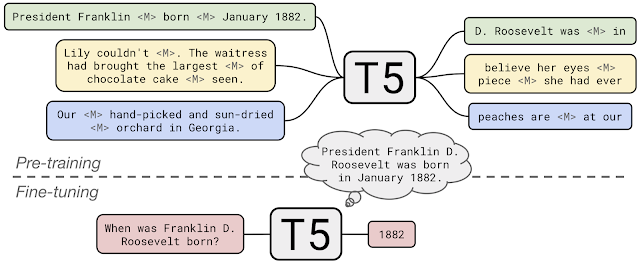

T5 oleh Google

CTRL oleh Salesforce

GShard oleh Google

GShard adalah model terjemahan bahasa raksasa itu Google memperkenalkan pada Juni 2020 untuk tujuan penskalaan jaringan saraf. Model ini mencakup 600 miliar parameter, yang memungkinkan pelatihan data dalam jumlah besar sekaligus. GShard sangat mahir terjemahan bahasa dan dilatih untuk menerjemahkan 100 bahasa ke dalam bahasa Inggris dalam empat hari.

Blender oleh Riset AI Facebook

Blender adalah chatbot sumber terbuka yang diperkenalkan pada April 2020 oleh Riset AI Facebook. Chatbot tercatat telah meningkatkan keterampilan percakapan dibandingkan model pesaing, dengan kemampuan untuk menyediakan poin pembicaraan yang menarik, mendengarkan dan menunjukkan pemahaman atas masukan mitranya, dan menunjukkan empati dan kepribadian.

Blender telah dibandingkan dengan chatbot Meena Google, yang pada gilirannya telah dibandingkan dengan GPT-2 OpenAI

Kode Blender tersedia di Parl.ai.

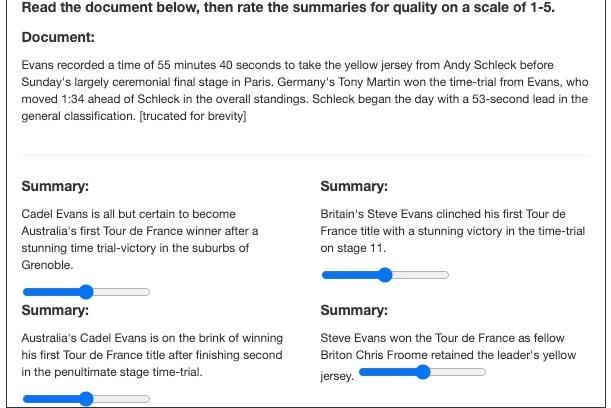

Pegasus oleh Google

Pegasus adalah model pemrosesan bahasa alami yang dulu diperkenalkan oleh Google pada Desember 2019. Pegasus dapat dilatih untuk membuat ringkasan, dan serupa dengan model lain seperti BERT, GPT-2, RoberTa, XLNet, ALBERT, dan T5, Pegasus dapat disesuaikan untuk tugas tertentu. Pegasus telah diuji efisiensinya dalam meringkas berita, sains, cerita, instruksi, email, paten, dan undang-undang legislatif dibandingkan dengan subjek manusia.

Kode Pegasus tersedia di GitHub.

Rekomendasi Editor

- Google Bard sekarang dapat berbicara, tetapi bisakah itu menenggelamkan ChatGPT?

- ChatGPT: berita terbaru, kontroversi, dan tips yang perlu Anda ketahui

- Lalu lintas situs web ChatGPT turun untuk pertama kalinya

- Fitur penjelajahan Bing ChatGPT dinonaktifkan karena kelemahan akses paywall

- Bot obrolan AI terbaik untuk dicoba: ChatGPT, Bard, dan lainnya