एक प्रसिद्ध टीवी शो के शीर्षक को थोड़ा संशोधित करने के लिए: बच्चे सबसे खतरनाक चीजें करते हैं। हाल ही में जर्मनी और यूके के शोधकर्ताओं ने एक अध्ययन किया, जर्नल में प्रकाशित विज्ञान रोबोटिक्स, इससे पता चला कि बच्चे किस हद तक रोबोट साथियों के दबाव के प्रति संवेदनशील हैं। टीएलडीआर संस्करण: माता-पिता के उस पुराने प्रश्न का उत्तर: "यदि आपके सभी दोस्त आपसे एक चट्टान से कूदने के लिए कहें, तो क्या आप ऐसा करेंगे?" हो सकता है “ज़रूर।” अगर मेरे सभी दोस्त रोबोट होते।”

अंतर्वस्तु

- क्या वयस्क सचमुच इतने अधिक होशियार होते हैं?

- प्रत्येक जहाज के लिए एक जहाज़ का मलबा होता है

परीक्षण ने पोलिश मनोवैज्ञानिक सोलोमन एश द्वारा शुरू किए गए 1951 के एक प्रसिद्ध प्रयोग को दोहराया। प्रयोग से पता चला कि लोग ग्रुपथिंक के दबाव से कैसे प्रभावित हो सकते हैं, भले ही यह उस जानकारी के विपरीत हो जिसे वे सही मानते हैं। एश के प्रयोगों में, कॉलेज के छात्रों के एक समूह को एक साथ इकट्ठा किया गया और दो कार्ड दिखाए गए। बाईं ओर के कार्ड में एक ऊर्ध्वाधर रेखा की छवि प्रदर्शित हुई। दाईं ओर के कार्ड में अलग-अलग लंबाई की तीन पंक्तियाँ प्रदर्शित थीं। फिर प्रयोगकर्ता ने प्रतिभागियों से पूछा कि दाएं कार्ड पर कौन सी रेखा बाएं कार्ड पर दिखाई गई रेखा की लंबाई से मेल खाती है।

अनुशंसित वीडियो

"बच्चों की उस आयु सीमा के बारे में विशेष बात यह है कि वे अभी भी उस उम्र में हैं जहां वे अविश्वास को निलंबित कर देंगे।"

अब तक, बहुत सीधा। हालाँकि, जहाँ चीजें अधिक कुटिल हो गईं, वह समूह की संरचना थी। समूह में से केवल एक व्यक्ति ही वास्तविक भागीदार था, जबकि अन्य सभी अभिनेता थे, जिन्हें समय से पहले बताया गया था कि क्या कहना है। प्रयोग यह परीक्षण करने के लिए था कि क्या वास्तविक प्रतिभागी बाकी समूह के साथ जाएगा जब उन्होंने सर्वसम्मति से गलत उत्तर दिया। जैसा कि यह निकला, अधिकांश करेंगे। साथियों के दबाव का अर्थ है कि अधिकांश लोग उस जानकारी को अस्वीकार कर देंगे जो स्पष्ट रूप से सही है यदि इसका मतलब बहुमत की राय के अनुरूप होना है।

संबंधित

- विकसित हो रहे, स्व-प्रतिकृति करने वाले रोबोट यहां हैं - लेकिन विद्रोह के बारे में चिंता न करें

- रोबोट आपकी नौकरी चुराने नहीं आ रहे हैं। वे इसे सुधारने आ रहे हैं

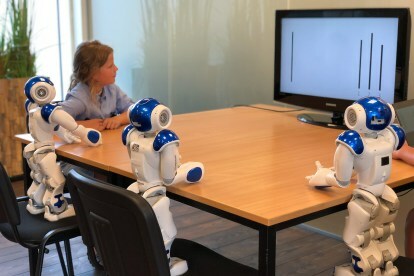

प्रयोग के 2018 रीमिक्स में, उसी सिद्धांत का उपयोग किया गया था - केवल कॉलेज उम्र के साथियों के समूह के बजाय, "असली प्रतिभागी" सात से नौ साल की उम्र का एक बच्चा था। "अभिनेताओं" की भूमिका तीन रोबोटों द्वारा निभाई गई, जिन्हें गलत उत्तर देने के लिए प्रोग्राम किया गया था। 43 स्वयंसेवकों के एक नमूने में, 74 प्रतिशत बच्चों ने रोबोट के समान ही गलत उत्तर दिया। परिणाम बताते हैं कि इस उम्र के अधिकांश बच्चे रोबोट के दबाव को अपने हाड़-मांस के साथियों के दबाव के समान ही मानेंगे।

"बच्चों की उस आयु सीमा के बारे में विशेष बात यह है कि वे अभी भी उस उम्र में हैं जहां वे अविश्वास को निलंबित कर देंगे," टोनी बेलपेमेइंटेलिजेंट और ऑटोनॉमस कंट्रोल सिस्टम के प्रोफेसर, जिन्होंने अध्ययन को अंजाम देने में मदद की, ने डिजिटल ट्रेंड्स को बताया। “वे खिलौनों से खेलेंगे और फिर भी विश्वास करेंगे कि उनकी एक्शन आकृतियाँ या गुड़िया असली हैं; वे अभी भी कठपुतली शो देखेंगे और वास्तव में विश्वास करेंगे कि क्या हो रहा है; वे अब भी [सांता क्लॉज़] पर विश्वास कर सकते हैं। यह वही बात है जब वे रोबोट को देखते हैं: वे इलेक्ट्रॉनिक्स और प्लास्टिक नहीं देखते हैं, बल्कि एक सामाजिक चरित्र देखते हैं।

दिलचस्प बात यह है कि प्रयोग ने इसकी तुलना वयस्कों की प्रतिक्रिया से की। बच्चों के विपरीत, वयस्क रोबोट की त्रुटियों से प्रभावित नहीं हुए। बेलपेम ने आगे कहा, "जब एक वयस्क ने रोबोट को गलत उत्तर देते हुए देखा, तो उन्होंने उसे हैरानी से देखा और फिर सही उत्तर दिया।"

तो फिर चिंता की कोई बात नहीं? जब तक हम बच्चों को खराब प्रतिक्रिया देने के लिए प्रोग्राम किए गए रोबोटों पर हाथ डालने से रोकते हैं, तब तक सब कुछ ठीक होना चाहिए, है ना? इतनी जल्दी मत करो.

क्या वयस्क सचमुच इतने अधिक होशियार होते हैं?

जैसा कि बेलपेम ने स्वीकार किया, यह कार्य इतना सरल बनाया गया था कि इसका उत्तर क्या होगा, इसके बारे में कोई अनिश्चितता नहीं थी। वास्तविक दुनिया अलग है. जब हम मशीनों को आसानी से सौंपे जाने वाले कार्यों के प्रकार के बारे में सोचते हैं, तो ये अक्सर ऐसे कार्य होते हैं जिन्हें हम, मनुष्य के रूप में, हमेशा पूरी तरह से करने में सक्षम नहीं होते हैं।

यह कार्य इतना सरल बनाया गया था कि इसका उत्तर क्या होगा इसके बारे में कोई अनिश्चितता नहीं थी।

यह हो सकता है कि कार्य अविश्वसनीय रूप से सरल हो, लेकिन मशीन इसे हमारी तुलना में काफी तेजी से निष्पादित कर सकती है। या यह एक अधिक जटिल कार्य हो सकता है, जिसमें कंप्यूटर के पास हमारी तुलना में कहीं अधिक मात्रा में डेटा तक पहुंच होती है। काम के संभावित प्रभाव के आधार पर, इसमें कोई आश्चर्य की बात नहीं है कि हममें से कई लोग मशीन को ठीक करने से नाखुश होंगे।

क्या अस्पताल में कोई नर्स इस नियम को पलटने से खुश होगी? एफडीए-अनुमोदित एल्गोरिदम जो महत्वपूर्ण संकेतों की निगरानी करके और फिर चिकित्सा कर्मचारियों को अलर्ट भेजकर रोगी के स्वास्थ्य के बारे में प्राथमिकताएं बनाने में मदद कर सकता है? या क्या कोई ड्राइवर विशेष रूप से जटिल सड़क परिदृश्य से निपटने के दौरान ड्राइवर रहित कार से पहिया चलाने में सहज होगा? या यहां तक कि एक पायलट ऑटोपायलट को नजरअंदाज कर रहा है क्योंकि उन्हें लगता है कि गलत निर्णय लिया जा रहा है? इन सभी मामलों में, हम यह सोचना चाहेंगे कि उत्तर "हाँ" है। हालाँकि, सभी प्रकार के कारणों से, यह वास्तविकता नहीं हो सकती है।

निकोलस कैर ने अपनी 2014 की किताब में इस बारे में लिखा है कांच का पिंजरा: स्वचालन हमें कहाँ ले जा रहा है. जिस तरह से वह इसका वर्णन करता है वह इस बात को रेखांकित करता है कि स्वचालन के वास्तविक जीवन के मामलों में किस तरह की अस्पष्टता शामिल है, समस्याएँ कहाँ हैं कार्ड पर एक लाइन की लंबाई की तुलना में कहीं अधिक जटिल, मशीनें बहुत अधिक स्मार्ट हैं, और परिणाम संभावित रूप से अधिक है महत्वपूर्ण।

“आप प्रयास और सहभागिता में कमी, या एजेंसी और स्वायत्तता में कमी, या कौशल में सूक्ष्म गिरावट की कीमत को कैसे मापेंगे? आप नहीं कर सकते," वह लिखते हैं। "ये उस प्रकार की अस्पष्ट, अमूर्त चीजें हैं जिनकी हम उनके चले जाने के बाद शायद ही कभी सराहना करते हैं, और तब भी हमें नुकसान को ठोस शब्दों में व्यक्त करने में परेशानी हो सकती है।"

"ये उस प्रकार की अस्पष्ट, अमूर्त चीजें हैं जिनकी हम उनके चले जाने के बाद शायद ही कभी सराहना करते हैं।"

जिस तरह के सोशल रोबोट के बारे में बेलपामे ने शोध पत्र में सिद्धांत दिया है, वे अभी तक मुख्यधारा में नहीं हैं, लेकिन इनमें से कुछ पहेली के उदाहरण पहले से ही मौजूद हैं। उदाहरण के लिए, कैर ने फेडरल एविएशन एडमिनिस्ट्रेशन मेमो के उल्लेख के साथ अपनी पुस्तक शुरू की है जिसमें उल्लेख किया गया है कि पायलटों को इससे उत्पन्न होने वाले जोखिमों के कारण ऑटोपायलट पर उड़ान भरने में कम समय बिताना चाहिए। यह क्रैश डेटा के विश्लेषण पर आधारित था, जिससे पता चलता है कि पायलट अक्सर कम्प्यूटरीकृत सिस्टम पर बहुत अधिक भरोसा करते हैं।

इसी तरह के एक मामले में 2009 का मुकदमा शामिल था जिसमें लॉरेन रोसेनबर्ग नाम की एक महिला थी गूगल के खिलाफ मुकदमा दायर किया खतरनाक यातायात वाले मार्ग पर चलने की सलाह दिए जाने के बाद। हालाँकि मामले को अदालत से बाहर कर दिया गया था, लेकिन इससे पता चलता है कि लोग इस विश्वास में अपने स्वयं के सामान्य ज्ञान को खत्म कर देंगे कि मशीन इंटेलिजेंस में हमसे अधिक बुद्धिमत्ता है।

प्रत्येक जहाज के लिए एक जहाज़ का मलबा होता है

अंततः, जैसा कि बेलपेम स्वीकार करते हैं, मुद्दा यह है कि कभी-कभी हम निर्णय लेने का काम मशीनों को सौंपना चाहते हैं। रोबोटों उन कार्यों को करने का वादा करें जो नीरस, गंदे और खतरनाक हैं - और अगर हमें हर निर्णय का दोबारा अनुमान लगाना है, तो वे वास्तव में श्रम-बचत वाले उपकरण नहीं हैं जिनका वादा किया गया है। यदि हम अंततः अपने घर में रोबोटों को आमंत्रित करने जा रहे हैं, तो हम चाहेंगे कि वे स्वायत्त रूप से कार्य करने में सक्षम हों, और इसमें एक निश्चित स्तर का विश्वास शामिल होगा।

“रोबोट का आप पर सामाजिक दबाव डालना अच्छी बात हो सकती है; यह भयावह नहीं होना चाहिए,'' बेलपेमे ने जारी रखा। “यदि आपके पास स्वास्थ्य देखभाल या शिक्षा में उपयोग किए जाने वाले रोबोट हैं, तो आप चाहते हैं कि वे आपको प्रभावित करने में सक्षम हों। उदाहरण के लिए, यदि आप अपना वजन कम करना चाहते हैं तो आपको दो महीने के लिए वजन घटाने वाला रोबोट दिया जा सकता है पर नज़र रखता है आपका कैलोरी सेवन और आपको अधिक व्यायाम करने के लिए प्रोत्साहित करता है। आप ऐसा रोबोट चाहते हैं जो प्रेरक हो और आपको प्रभावित करे। लेकिन कोई भी तकनीक जिसका इस्तेमाल अच्छे के लिए किया जा सकता है, उसका इस्तेमाल बुराई के लिए भी किया जा सकता है।”

इसका उत्तर क्या है? इस तरह के प्रश्नों पर केस-दर-केस आधार पर बहस की जाएगी। यदि अंतत: बुराई अच्छे से अधिक हो जाती है, तो सामाजिक रोबोट जैसी तकनीक कभी सफल नहीं होगी। लेकिन यह महत्वपूर्ण है कि हम रोबोट-प्रेरित सहकर्मी दबाव जैसे अध्ययनों से सही सबक लें। और यह सच नहीं है कि हम बच्चों से कहीं अधिक होशियार हैं।

संपादकों की सिफ़ारिशें

- स्वचालन का भविष्य: रोबोट आ रहे हैं, लेकिन वे आपका काम नहीं लेंगे

- ये रोबोट खरपतवारों को नष्ट कर देते हैं ताकि किसानों को रासायनिक शाकनाशियों की आवश्यकता न पड़े