OpenAI के GPT-2 टेक्स्ट-जनरेटिंग एल्गोरिदम को एक समय रिलीज़ करने के लिए बहुत खतरनाक माना जाता था। फिर यह रिलीज़ हो गया - और दुनिया बदलती रही।

अंतर्वस्तु

- यह अच्छा क्यों है? बिल्कुल सब कुछ

- और अधिक वह कहां से आया

- प्रशंसनीय बैल***टी

- चीनी कक्ष में वापस

- स्टोकेस्टिक तोतों को खाना खिलाना

- भाषा मॉडल और ए.आई. का भविष्य

पीछे मुड़कर देखने पर, तुलनात्मक रूप से छोटा GPT-2 भाषा मॉडल (लगभग 1.5 बिलियन पैरामीटर) इसके सीक्वल, GPT-3 के सामने बहुत ही तुच्छ दिखता है। जो 175 अरब मापदंडों का विशाल दावा करता है, इसे 45 टीबी टेक्स्ट डेटा पर प्रशिक्षित किया गया था, और इसकी लागत कथित तौर पर $12 मिलियन (कम से कम) थी निर्माण।

“हमारा दृष्टिकोण, और उस समय हमारा दृष्टिकोण, एक चरणबद्ध रिलीज़ करना था, जो शुरू में, जैसा था, आप रिलीज़ करते हैं छोटा मॉडल और आप इंतजार करें और देखें कि क्या होता है,'' संधिनी अग्रवाल, एक ए.आई. OpenAI के नीति शोधकर्ता ने डिजिटल को बताया रुझान. “अगर चीजें अच्छी लगती हैं, तो आप मॉडल का अगला आकार जारी करते हैं। हमने वह दृष्टिकोण इसलिए अपनाया क्योंकि, ईमानदारी से कहें तो, यह [न केवल हमारे लिए अज्ञात जल है, बल्कि यह पूरी दुनिया के लिए भी अज्ञात जल है।''

संबंधित

- मज़ेदार फ़ॉर्मूला: क्यों मशीन से उत्पन्न हास्य ए.आई. की पवित्र कब्र है?

- ए.आई. का भविष्य: अगले कुछ वर्षों में देखने लायक 4 बड़ी चीज़ें

- भावना-संवेदन ए.आई. यहाँ है, और यह आपके अगले नौकरी साक्षात्कार में हो सकता है

नौ महीने बाद, वर्तमान दिन की ओर आगे बढ़ें GPT-3 पिछली गर्मियों में रिलीज़ हुई, और यह शक्ति प्रदान कर रहा है 300 से अधिक आवेदन जबकि प्रति दिन 4.5 बिलियन शब्दों का विशाल सृजन होता है। किसी दस्तावेज़ के केवल पहले कुछ वाक्यों के साथ, यह एक ही शैली में प्रतीत होता है कि अंतहीन अधिक पाठ उत्पन्न करने में सक्षम है - यहां तक कि काल्पनिक उद्धरण भी शामिल हैं।

क्या यह दुनिया को नष्ट कर देगा? पिछले इतिहास के आधार पर, लगभग निश्चित रूप से नहीं। लेकिन यह A.I के कुछ गेम-चेंजिंग एप्लिकेशन बना रहा है। संभव है, रास्ते में कुछ बहुत ही गहन प्रश्न पूछते हुए।

यह अच्छा क्यों है? बिल्कुल सब कुछ

हाल ही में एक स्टार्टअप के संस्थापक फ्रांसिस जर्विस ने फोन किया संवर्धित, किराए की समस्या से जूझ रहे लोगों को किराए में छूट पर बातचीत करने हेतु पत्र लिखने में मदद करने के लिए GPT-3 का उपयोग किया। जर्विस ने डिजिटल ट्रेंड्स को बताया, "मैं यहां उपयोग के मामले को 'स्टाइल ट्रांसफर' के रूप में वर्णित करूंगा।" "[यह] बुलेट पॉइंट लेता है, जिसका पूर्ण अंग्रेजी में होना भी जरूरी नहीं है, और [आउटपुट] औपचारिक भाषा में दो से तीन वाक्य होते हैं।"

अनुशंसित वीडियो

इस अति-शक्तिशाली भाषा मॉडल द्वारा संचालित, जर्विस का उपकरण किरायेदारों को उनकी स्थिति और कारण का वर्णन करने की अनुमति देता है कि उन्हें रियायती निपटान की आवश्यकता है। कंपनी का दावा है, "आपने अपनी आय क्यों खो दी, इसके बारे में बस कुछ शब्द दर्ज करें और कुछ ही सेकंड में आपको अपने पत्र में जोड़ने के लिए एक सुझाया गया प्रेरक, औपचारिक पैराग्राफ मिलेगा।"

यह केवल एक ऊपरी हिस्सा है। कब आदित्य जोशीएक मशीन लर्निंग वैज्ञानिक और पूर्व अमेज़ॅन वेब सर्विसेज इंजीनियर, पहली बार GPT-3 के संपर्क में आए, उन्होंने जो देखा उससे वे इतने प्रभावित हुए कि उन्होंने एक वेबसाइट बनाई, www.gpt3examples.com, सर्वोत्तम लोगों पर नज़र रखने के लिए।

उन्होंने डिजिटल ट्रेंड्स को बताया, "ओपनएआई द्वारा अपने एपीआई की घोषणा के तुरंत बाद, डेवलपर्स ने जीपीटी-3 का उपयोग करके बनाए गए एप्लिकेशन के प्रभावशाली डेमो ट्वीट करना शुरू कर दिया।" “वे आश्चर्यजनक रूप से अच्छे थे। मैंने समुदाय के लिए इन उदाहरणों को ढूंढना और अपने डोमेन में समस्याओं को हल करने के लिए GPT-3 का उपयोग करने के रचनात्मक तरीकों की खोज करना आसान बनाने के लिए [मेरी वेबसाइट] बनाई।

GPT-3 और के साथ पूरी तरह से इंटरैक्टिव सिंथेटिक व्यक्तित्व https://t.co/ZPdnEqR0Hn 🎇

वे जानते हैं कि वे कौन हैं, उन्होंने कहाँ काम किया, उनका बॉस कौन है, और भी बहुत कुछ। यह आपके पिता का बॉट नहीं है... pic.twitter.com/kt4AtgYHZL

- टायलर लास्टोविच (@tylerlastovich) 18 अगस्त 2020

जोशी कई डेमो की ओर इशारा करते हैं जिन्होंने वास्तव में उन पर प्रभाव डाला। एक लेआउट जनरेटर, एक साधारण पाठ विवरण से जावास्क्रिप्ट कोड उत्पन्न करके एक कार्यात्मक लेआउट प्रस्तुत करता है। क्या आप तरबूज के आकार में "सदस्यता लें" कहने वाला बटन चाहते हैं? इंद्रधनुष के रंगों वाले बटनों की श्रृंखला के साथ कुछ बैनर टेक्स्ट की कल्पना करें? बस उन्हें मूल पाठ में समझाएं, और शरीफ शमीम का लेआउट जनरेटर आपके लिए कोड लिख देगा। एक और, ए GPT-3 आधारित खोज इंजन पारस चोपड़ा द्वारा निर्मित, किसी भी लिखित प्रश्न को उत्तर और अधिक जानकारी प्रदान करने के लिए एक यूआरएल लिंक में बदल सकता है। एक और, माइकल टेफुला द्वारा लिखित फ्रांसिस जर्विस का उलटा, कानूनी दस्तावेज़ों का अनुवाद करता है सादे अंग्रेजी में. राफेल मिलियेर द्वारा एक और, दार्शनिक निबंध लिखते हैं. और एक अन्य, ग्वेर्न ब्रैनवेन द्वारा, कर सकते हैं रचनात्मक कल्पना उत्पन्न करें.

जोशी ने कहा, "मुझे उम्मीद नहीं थी कि एक भाषा मॉडल भाषा अनुवाद और पीढ़ी से लेकर पाठ सारांश और इकाई निष्कर्षण तक इतने विविध कार्यों पर इतना अच्छा प्रदर्शन करेगा।" "में मेरे अपने प्रयोगों में से एक, मैंने रासायनिक दहन प्रतिक्रियाओं की भविष्यवाणी करने के लिए GPT-3 का उपयोग किया, और इसने आश्चर्यजनक रूप से अच्छा प्रदर्शन किया।

और अधिक वह कहां से आया

GPT-3 का परिवर्तनकारी उपयोग यहीं समाप्त नहीं होता है। संगणक वैज्ञानिक टायलर लास्टोविच के लिए GPT-3 का उपयोग किया है नकली लोग पैदा करो, जिसमें बैकस्टोरी भी शामिल है, जिसके साथ पाठ के माध्यम से बातचीत की जा सकती है। इस बीच, एंड्रयू मेने ने दिखाया है कि GPT-3 हो सकता है फिल्म के शीर्षकों को इमोजी में बदलने के लिए उपयोग किया जाता है. निक वाल्टन, लैटीट्यूड के मुख्य प्रौद्योगिकी अधिकारी, जीपीटी-जनरेटेड टेक्स्ट एडवेंचर गेम के पीछे का स्टूडियो ऐ कालकोठरी हाल ही में यह देखने के लिए भी ऐसा ही किया कि क्या यह बदल सकता है इमोजी में पाठ विवरण की लंबी पंक्तियाँ. और Copy.ai, एक स्टार्टअप जो GPT-3 के साथ कॉपी राइटिंग टूल बनाता है, मासिक आधार पर इस मॉडल का उपयोग कर रहा है। $67,000 का आवर्ती राजस्व मार्च तक - और हाल ही में $2.9 मिलियन का फंडिंग राउंड।

पिछले कुछ दशकों में मशीन लर्निंग हर तरह से गेम-चेंजर रही है।

"निश्चित रूप से, जिस रचनात्मकता के लिए लोगों ने GPT-3 का उपयोग किया है, उसे लेकर आश्चर्य और बहुत विस्मय था," संधिनी अग्रवाल, एक ए.आई. OpenAI के नीति शोधकर्ता ने डिजिटल ट्रेंड्स को बताया। “इतने सारे उपयोग के मामले बहुत रचनात्मक हैं, और उन डोमेन में जिनके बारे में मैंने भी अनुमान नहीं लगाया था, इसके बारे में बहुत अधिक जानकारी होगी। यह देखना दिलचस्प है. लेकिन कहा जा रहा है कि, GPT-3 - और अनुसंधान की यह पूरी दिशा जिसे OpenAI ने अपनाया - इस उम्मीद के साथ थी कि यह हमें A.I देगा। वह मॉडल जो अधिक सामान्य-उद्देश्य वाला था। सामान्य प्रयोजन ए.आई. का संपूर्ण बिंदु मॉडल है [कि यह होगा] एक ऐसा मॉडल जो ये सभी अलग-अलग ए.आई. कर सकता है। कार्य।"

कई परियोजनाएँ GPT-3 के बड़े मूल्यवर्द्धनों में से एक पर प्रकाश डालती हैं: इसके लिए आवश्यक प्रशिक्षण की कमी। पिछले कुछ दशकों में मशीन लर्निंग हर तरह से परिवर्तनकारी रही है। लेकिन मशीन लर्निंग को सही उत्तर देने में सक्षम होने के लिए बड़ी संख्या में प्रशिक्षण उदाहरणों की आवश्यकता होती है। दूसरी ओर, GPT-3 में "कुछ शॉट क्षमता" है जो इसे केवल कुछ मुट्ठी भर उदाहरणों के साथ कुछ करना सिखाने की अनुमति देती है।

प्रशंसनीय बैल***टी

GPT-3 अत्यधिक प्रभावशाली है. लेकिन यह चुनौतियाँ भी पेश करता है। इनमें से कुछ लागत से संबंधित हैं: चैटबॉट्स जैसी उच्च-मात्रा सेवाओं के लिए, जो जीपीटी-3 के जादू से लाभान्वित हो सकते हैं, उपकरण का उपयोग करना बहुत महंगा हो सकता है। (एक संदेश की लागत 6 सेंट हो सकती है, जो कि बैंक-ब्रेकिंग तो नहीं है, लेकिन निश्चित रूप से बढ़ जाती है।)

अन्य लोग इसकी व्यापक उपलब्धता से संबंधित हैं, जिसका अर्थ है कि विशेष रूप से स्टार्टअप बनाना कठिन होने की संभावना है क्योंकि भयंकर प्रतिस्पर्धा से मार्जिन कम होने की संभावना है।

दूसरा है स्मृति की कमी; इसकी संदर्भ विंडो पहले एक बार में 2,000 शब्दों से कुछ कम चलती है, जैसे फिल्म में गाइ पियर्स का चरित्र स्मृति चिन्ह, इसकी मेमोरी रीसेट हो गई है। "यह महत्वपूर्ण रूप से उत्पन्न होने वाले पाठ की लंबाई को सीमित करता है, मोटे तौर पर प्रति अनुरोध एक छोटे पैराग्राफ तक," लास्टोविच ने कहा। "व्यावहारिक रूप से कहें तो, इसका मतलब यह है कि शुरुआत में जो हुआ उसे याद रखते हुए यह लंबे दस्तावेज़ तैयार करने में असमर्थ है।"

हालाँकि, शायद सबसे उल्लेखनीय चुनौती इसकी सबसे बड़ी ताकत से भी संबंधित है: इसकी बातचीत क्षमताएँ। कॉन्फैब्यूलेशन एक शब्द है जिसका उपयोग डॉक्टरों द्वारा अक्सर यह वर्णन करने के लिए किया जाता है कि स्मृति समस्याओं वाले कुछ लोग कैसे सक्षम होते हैं ऐसी जानकारी गढ़ना जो शुरू में विश्वसनीय लगती हो, लेकिन जरूरी नहीं कि बारीकी से जांच करने पर खरी उतरती हो निरीक्षण। GPT-3 की बातचीत करने की क्षमता, संदर्भ के आधार पर, एक ताकत और एक कमजोरी है। रचनात्मक परियोजनाओं के लिए, यह बहुत अच्छा हो सकता है, जो इसे सत्य जैसी सांसारिक किसी भी चीज़ की चिंता किए बिना विषयों पर विचार करने की अनुमति देता है। अन्य परियोजनाओं के लिए, यह अधिक पेचीदा हो सकता है।

ऑग्रेंटेड के फ़्रांसिस जर्विस ने GPT-3 की "प्रशंसनीय बकवास उत्पन्न करने" की क्षमता का उल्लेख किया है। के निक वाल्टन ऐ कालकोठरी कहा: "GPT-3 रचनात्मक पाठ लिखने में बहुत अच्छा है, ऐसा लगता है कि यह किसी मानव द्वारा लिखा गया हो सकता है... इसका एक हालाँकि, कमज़ोरियाँ यह है कि यह अक्सर ऐसे लिख सकता है जैसे कि यह बहुत आश्वस्त हो - भले ही इसे पता न हो कि किसी प्रश्न का उत्तर क्या होगा प्रश्न है।"

चीनी कक्ष में वापस

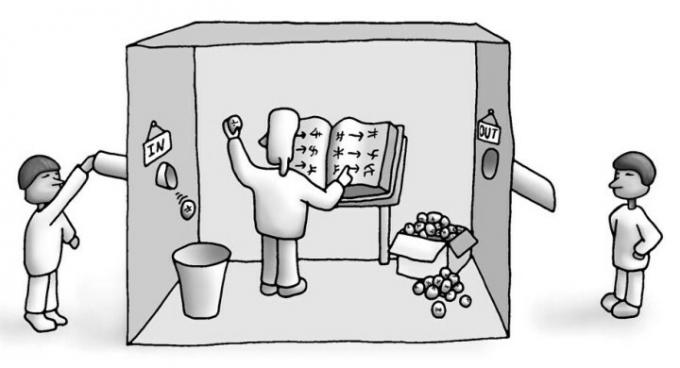

इस संबंध में, GPT-3 हमें जॉन सियरल के चीनी कक्ष के परिचित मैदान में ले जाता है। 1980 में, एक दार्शनिक, सियरल ने प्रकाशित किया सबसे प्रसिद्ध ए.आई. में से एक विचार प्रयोग, "समझ" के विषय पर केंद्रित है। चाइनीज़ रूम हमें एक ऐसे व्यक्ति की कल्पना करने के लिए कहता है जो एक कमरे में बंद है और बड़ी संख्या में ऐसी भाषा में लिख रहा है जिसे वे नहीं समझते हैं। वे केवल अमूर्त प्रतीकों को पहचानते हैं। कमरे में नियमों का एक सेट भी है जो दर्शाता है कि प्रतीकों का एक सेट दूसरे से कैसे मेल खाता है। उत्तर देने के लिए प्रश्नों की एक श्रृंखला को देखते हुए, कमरे में रहने वाले को प्रश्न चिह्नों को उत्तर चिह्नों से मिलाना होगा। इस कार्य को कई बार दोहराने के बाद, वे इसे करने में माहिर हो जाते हैं - भले ही उन्हें पता नहीं होता कि प्रतीकों के किसी भी सेट का क्या मतलब है, केवल यह कि एक दूसरे से मेल खाता है।

GPT-3 भाषाई ए.आई. के प्रकारों से दूर एक दुनिया है। वह उस समय अस्तित्व में था जब सियरल लिख रहा था। हालाँकि, समझने का सवाल हमेशा की तरह कांटेदार है।

"यह पूछताछ का एक बहुत ही विवादास्पद क्षेत्र है, जैसा कि मुझे यकीन है कि आप जानते हैं, क्योंकि इसमें बहुत सारे मतभेद हैं इस पर राय, सामान्य तौर पर, भाषा मॉडल... में कभी भी [सच्ची] समझ होगी," ओपनएआई की संधिनी ने कहा अग्रवाल. “अगर आप मुझसे अभी GPT-3 के बारे में पूछें, तो यह कभी-कभी बहुत अच्छा प्रदर्शन करता है, लेकिन कभी-कभी बहुत अच्छा नहीं। एक तरह से यह यादृच्छिकता है कि आउटपुट आपको कितना सार्थक लग सकता है। कभी-कभी आप आउटपुट से आश्चर्यचकित हो सकते हैं, और कभी-कभी आउटपुट निरर्थक होगा। यह देखते हुए, अभी मेरी राय में... GPT-3 में समझ नहीं है।"

चीनी कक्ष प्रयोग में आज एक अतिरिक्त मोड़ यह है कि GPT-3 को शोधकर्ताओं की एक छोटी टीम द्वारा हर कदम पर प्रोग्राम नहीं किया जाता है। यह एक विशाल मॉडल है जिसे इंटरनेट सहित विशाल डेटासेट पर प्रशिक्षित किया गया है। इसका मतलब यह है कि यह उन निष्कर्षों और पूर्वाग्रहों को उठा सकता है जिन्हें ऑनलाइन पाए जाने वाले पाठ में एन्कोड किया जा सकता है। क्या आपने यह अभिव्यक्ति सुनी है कि आप जिन पाँच लोगों से घिरे रहते हैं उनमें से औसतन आप ही हैं? खैर, GPT-3 को किताबों, विकिपीडिया और अन्य लेखों सहित कई स्रोतों से लगभग अथाह मात्रा में टेक्स्ट डेटा पर प्रशिक्षित किया गया था। इससे, यह पहले इस्तेमाल किए गए शब्द संयोजनों को देखने के लिए अपने प्रशिक्षण डेटा को खंगालकर किसी भी क्रम में अगले शब्द की भविष्यवाणी करना सीखता है। इसके अनपेक्षित परिणाम हो सकते हैं.

स्टोकेस्टिक तोतों को खाना खिलाना

बड़े भाषा मॉडल के साथ इस चुनौती को पहली बार हाइलाइट किया गया था अभूतपूर्व कागज तथाकथित स्टोकेस्टिक तोते के विषय पर। एक स्टोकेस्टिक तोता - लेखकों द्वारा गढ़ा गया एक शब्द, जिन्होंने अपने रैंकों में Google के नैतिक ए.आई. के पूर्व सह-प्रमुख को शामिल किया था। टीम, टिम्निट गेब्रु - एक बड़े भाषा मॉडल को संदर्भित करता है "अव्यवस्थित रूप से [टांके] एक साथ भाषाई रूपों के अनुक्रमों को इसने अपने विशाल प्रशिक्षण डेटा में देखा है, वे कैसे संयोजित होते हैं, इसके बारे में संभाव्य जानकारी के अनुसार, लेकिन बिना किसी संदर्भ के अर्थ के लिए।”

"इंटरनेट के एक बड़े हिस्से पर प्रशिक्षित होने के बाद, यह स्वीकार करना महत्वपूर्ण है कि इसमें कुछ पूर्वाग्रह होंगे," अल्बर्ट गूज़ीएक अन्य GPT-3 उपयोगकर्ता ने डिजिटल ट्रेंड्स को बताया। "मुझे पता है कि ओपनएआई टीम कुछ अलग तरीकों से इसे कम करने के लिए कड़ी मेहनत कर रही है, लेकिन मुझे उम्मीद है कि आने वाले समय में यह एक मुद्दा रहेगा।"

पूर्वाग्रह से बचाव के लिए ओपनएआई के जवाबी उपायों में एक विषाक्तता फ़िल्टर शामिल है, जो कुछ भाषा या विषयों को फ़िल्टर करता है। ओपनएआई मानवीय फीडबैक को एकीकृत करने के तरीकों पर भी काम कर रहा है ताकि यह निर्दिष्ट किया जा सके कि किन क्षेत्रों में भटकना नहीं है। इसके अलावा, टीम टूल तक पहुंच को नियंत्रित करती है ताकि टूल के कुछ नकारात्मक उपयोगों को एक्सेस नहीं दिया जा सके।

"पूर्वाग्रह और स्पष्ट रिटर्न की संभावना बिल्कुल मौजूद है और इससे बचने के लिए डेवलपर्स को प्रयास की आवश्यकता है।"

अग्रवाल ने कहा, "शायद आपने इनमें से बहुत से दुर्भावनापूर्ण उपयोगकर्ताओं को नहीं देखा है, इसका एक कारण यह है कि हमारे पास आंतरिक रूप से एक गहन समीक्षा प्रक्रिया है।" “जिस तरह से हम काम करते हैं वह यह है कि हर बार जब आप किसी उत्पाद में GPT-3 का उपयोग करना चाहते हैं जो वास्तव में तैनात किया जाएगा, तो आप एक ऐसी प्रक्रिया से गुजरना होगा जहां एक टीम - जैसे, मनुष्यों की एक टीम - वास्तव में समीक्षा करती है कि आप कैसे उपयोग करना चाहते हैं यह।... फिर, यह सुनिश्चित करने के आधार पर कि यह कुछ दुर्भावनापूर्ण नहीं है, आपको पहुंच प्रदान की जाएगी।

हालाँकि, इनमें से कुछ चुनौतीपूर्ण है - कम से कम नहीं क्योंकि पूर्वाग्रह हमेशा कुछ शब्दों के उपयोग का स्पष्ट मामला नहीं होता है। जर्विस का कहना है कि, कभी-कभी, उनके GPT-3 किराये के संदेश "रूढ़िवादी लिंग [या] वर्ग की ओर प्रवृत्त हो सकते हैं धारणाएँ।" ध्यान न दिए जाने पर, यह उनके परिवार के आधार पर, किराये के पत्र पर विषय की लिंग पहचान मान सकता है भूमिका या नौकरी. यह ए.आई. का सबसे गंभीर उदाहरण नहीं हो सकता है। पूर्वाग्रह, लेकिन यह इस बात पर प्रकाश डालता है कि जब बड़ी मात्रा में डेटा ग्रहण किया जाता है और फिर भाषा मॉडल में संभावित रूप से पुन: एकत्रित किया जाता है तो क्या होता है।

टायलर लास्टोविच ने कहा, "पूर्वाग्रह और स्पष्ट रिटर्न की संभावना बिल्कुल मौजूद है और इससे बचने के लिए डेवलपर्स को प्रयास की आवश्यकता है।" “ओपनएआई संभावित विषाक्त परिणामों को चिह्नित करता है, लेकिन अंततः यह एक दायित्व जोड़ता है जिसके बारे में ग्राहकों को मॉडल को उत्पादन में डालने से पहले गंभीरता से सोचना होगा। एक विशेष रूप से कठिन बढ़त का मामला मॉडल की झूठ बोलने की प्रवृत्ति को विकसित करना है - क्योंकि इसमें सही या गलत जानकारी की कोई अवधारणा नहीं है।

भाषा मॉडल और ए.आई. का भविष्य

अपनी शुरुआत के नौ महीने बाद, GPT-3 निश्चित रूप से गेम चेंजर के रूप में अपनी बिलिंग पर खरा उतर रहा है। जो एक बार पूरी तरह से संभावित था उसने खुद को संभावित रूप से साकार कर दिखाया है। GPT-3 के लिए दिलचस्प उपयोग के मामलों की संख्या इस बात पर प्रकाश डालती है कि कैसे एक टेक्स्ट-जनरेटिंग A.I. यह उस वर्णन से कहीं अधिक बहुमुखी है।

ऐसा नहीं है कि यह इन दिनों ब्लॉक पर नया बच्चा है। इस वर्ष की शुरुआत में, GPT-3 को सबसे बड़े भाषा मॉडल के रूप में पछाड़ दिया गया था। Google Brain ने एक नया भाषा मॉडल लॉन्च किया कुछ 1.6 ट्रिलियन मापदंडों के साथ, जिससे यह OpenAI की पेशकश से नौ गुना बड़ा हो गया। न ही यह भाषा मॉडलों के लिए सड़क का अंत होने की संभावना है। ये अत्यंत शक्तिशाली उपकरण हैं - जिनमें समाज में परिवर्तन लाने की क्षमता है, संभावित रूप से बेहतर और बदतर के लिए।

इन प्रौद्योगिकियों के साथ चुनौतियाँ निश्चित रूप से मौजूद हैं, और ये ऐसी चुनौतियाँ हैं जिनका समाधान OpenAI, स्वतंत्र शोधकर्ताओं और अन्य जैसी कंपनियों को जारी रखना चाहिए। लेकिन समग्र रूप से देखा जाए तो यह तर्क करना कठिन है कि भाषा मॉडल कृत्रिम बुद्धिमत्ता अनुसंधान के सबसे दिलचस्प और महत्वपूर्ण क्षेत्रों में से एक नहीं बन रहे हैं।

किसने सोचा होगा कि टेक्स्ट जेनरेटर इतने महत्वपूर्ण हो सकते हैं? कृत्रिम बुद्धिमत्ता के भविष्य में आपका स्वागत है।

संपादकों की सिफ़ारिशें

- एनालॉग ए.आई.? यह पागलपन जैसा लगता है, लेकिन यह भविष्य हो सकता है

- ए.आई. का अत्यंत सुंदर 'सिंथेटिक शास्त्र' पढ़ें। वह सोचता है कि यह भगवान है

- एल्गोरिथम वास्तुकला: क्या हमें ए.आई. को अनुमति देनी चाहिए? हमारे लिए इमारतें डिज़ाइन करें?

- बाइट वाली महिलाएं: ए.आई. के साथ 'गंदी मानवीय समस्याओं' को हल करने की विविएन मिंग की योजना

- रोबोटों को लुका-छिपी खेलना सिखाना अगली पीढ़ी के ए.आई. की कुंजी क्यों हो सकता है?