La bonne nouvelle? Ils restent encore méconnaissables pour la grande majorité des gens. Les mauvaises nouvelles? Ils ne trompent pas l’informatique moderne.

Vidéos recommandées

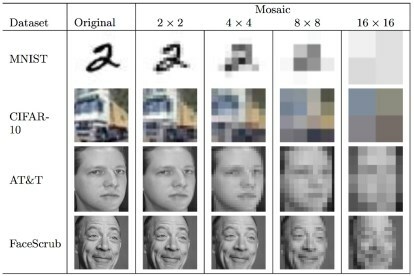

Cette information est conforme à un nouveau projet mené par des chercheurs de l'Université du Texas à Austin et de l'Université Cornell, qui a utilisé l'apprentissage en profondeur à deviner correctement les identités expurgées de personnes cachées par l'obscurcissement. Alors que les humains ont deviné correctement les identités expurgées dans 0,19 % du temps, le système d’apprentissage automatique a été capable de porter un jugement correct avec une précision de 83 %, lorsqu’on lui a permis cinq tentatives.

« Le flou et la pixellisation sont souvent utilisés pour masquer l’identité des personnes sur les photos et les vidéos. »

Vitali Chmatikov, professeur d'informatique à Cornell, a déclaré à Digital Trends. « Dans bon nombre de ces scénarios, l’adversaire a une assez bonne idée d’un petit ensemble de personnes possibles. qui aurait pu apparaître sur l'image, et il lui suffit de déterminer lesquels d'entre eux sont dans l'image. image."C’est exactement le scénario dans lequel la technologie de l’équipe fonctionne bien, a poursuivi Shmatikov. "Cela montre que le flou, la pixellisation et d'autres méthodes d'obscurcissement des images peuvent ne pas offrir beaucoup de protection lorsque l'exposition de l'identité d'une personne la mettrait en danger", a-t-il déclaré.

Le défi, bien sûr, est que ces méthodes d’expurgation de l’identité d’une personne sont souvent utilisées pour protéger une personne, comme un lanceur d’alerte ou un témoin d’un crime. En appliquant de tels algorithmes de reconnaissance d'images, basés sur réseaux de neurones artificiels, aux images qui ont donc été obscurcies à l’aide d’outils disponibles dans le commerce, des personnes pourraient potentiellement être mises en danger.

"Le défi fondamental consiste à combler le fossé entre les technologies de protection de la vie privée et l'apprentissage automatique", a déclaré Shmatikov. « De nombreux concepteurs de technologies de confidentialité n’apprécient pas pleinement la puissance de l’apprentissage automatique moderne, ce qui conduit à des technologies qui ne protègent pas réellement la vie privée. »

Recommandations des rédacteurs

- Ne payez pas la taxe Verizon 5G pour le Google Pixel 4a 5G

- Ne parlez pas: ce portable vous permet de donner des commandes vocales sans dire un mot

- Ne vous y trompez pas: ce système automatisé manipule sournoisement le contenu vidéo

Améliorez votre style de vieDigital Trends aide les lecteurs à garder un œil sur le monde en évolution rapide de la technologie avec toutes les dernières nouvelles, des critiques de produits amusantes, des éditoriaux perspicaces et des aperçus uniques.