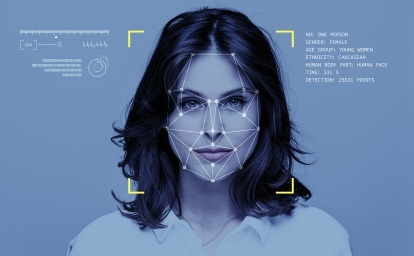

Le dernier exemple de l’orgueil de la Silicon Valley est l’application de reconnaissance faciale. IA Clearview. L'application de la petite startup est si puissante que quelqu'un pourrait vous approcher dans la rue, prendre votre photo et découvrir rapidement votre nom, votre adresse et votre numéro de téléphone, selon un rapport dans le New York Times.

Contenu

- Un nouvel outil pour les agresseurs

- Un problème persistant

Cette technologie semble probablement être une excellente idée pour deux types de personnes: Forces de l'ordre et ça fait peur. Les défenseurs craignent que ce type de technologie de reconnaissance faciale ne soit une aubaine pour les harceleurs, les personnes ayant un antécédents de violence domestique, et toute autre personne qui voudrait tout savoir sur vous pour un but néfaste but.

Vidéos recommandées

"Alors que la nouvelle de cette application se répandait, les femmes du monde entier ont soupiré", a déclaré Jo O'Reilly, défenseure de la vie privée chez ProPrivacy, basée au Royaume-Uni, dans une déclaration à Digital Trends. « Une fois de plus, la sécurité des femmes, tant en ligne que dans la vie réelle, est passée au second plan derrière le désir des startups technologiques de créer – et de monétiser – une technologie toujours plus invasive. »

En rapport

- Amazon déploie l'IA pour résumer les avis sur les produits

- L’IA a transformé Breaking Bad en anime – et c’est terrifiant

- La technologie de reconnaissance faciale pour les ours vise à assurer la sécurité des humains

Clearview fonctionne, en partie, en récupérant les données accessibles au public sur les sites de médias sociaux populaires comme Facebook, Twitter, YouTube et Venmo, entre autres. Un porte-parole de la société Facebook a déclaré à Digital Trends que « le grattage

Un nouvel outil pour les agresseurs

Le harcèlement criminel est depuis longtemps un problème pour les femmes en ligne, et ce, sans outil permettant de retrouver une personne uniquement sur la base de son visage. Pour l’instant, Clearview affirme vendre ses services uniquement aux forces de l’ordre, qui ont donné des critiques vraiment élogieuses sur la technologie. "Ils restent cependant étrangement silencieux sur le fait que, entre de mauvaises mains, ce logiciel pourrait être utilisé pour harceler et traquer presque n'importe qui", a déclaré O'Reilly. "Cela serait impossible à empêcher si le logiciel était mis à la disposition du public – un scénario que les investisseurs de Clearview ont reconnu comme étant possible."

"Toute technologie que vous développez et qui sera consommée par les humains, vous devez penser à ses défauts", a déclaré Crystal Justice, directrice du marketing et du développement chez la ligne d'assistance nationale contre la violence domestique . « Les agresseurs sont toujours à la recherche du prochain outil dans leur boîte à outils. »

La hotline a commencé à signaler les abus numériques en tant que catégorie spécifique en 2015, et a depuis lors constaté une forte augmentation de ces chiffres, en particulier chez les jeunes. Justice a déclaré à Digital Trends que la hotline avait reçu 371 000 contacts en 2018, dont 15 % étaient des plaintes pour abus numériques. En moyenne à l’échelle nationale, une femme sur quatre et un homme sur sept sont des survivants de violence domestique, selon les chiffres de la hotline.

« Les survivants représentent une grande partie de notre population », a déclaré Justice. « Les entreprises technologiques doivent tenir compte de l’expérience des survivants lors de la conception de leurs applications. »

Un problème persistant

Il s’agit d’une tendance persistante avec beaucoup de technologies perturbatrices de nos jours. Lorsque Uber a été lancé en 2009, la technologie semblait trop cool pour être vraie. Nous n’étions plus esclaves des industries des taxis ou des transports en commun incompétents dans nos villes respectives.

Bien entendu, le modèle d’Uber allait directement à l’encontre des idées reçues que nous avions apprises lorsque nous étions enfants: ne montez pas dans les voitures avec des inconnus. Dix ans et plusieurs milliers de procèssuite à une agression sexuelle plus tard, il semblerait qu’il y ait une raison qui relève de la sagesse conventionnelle. Pour beaucoup de gens, monter dans la voiture d’un inconnu n’est pas sécuritaire, même si vous payez pour être là.

Mais cet élément de penser à la sécurité, ou de devoir se déplacer à travers le monde en se souciant constamment de sa sécurité physique, comme beaucoup les femmes et les personnes de genre minoritaire doivent le faire, cela ne semble pas avoir été dans l’esprit des hommes (pour la plupart blancs) qui ont fondé des entreprises technologiques comme Uber, comme Twitter, comme tant d'autres. Ils voulaient juste créer quelque chose de cool qui changerait le monde. L’idée qu’il serait utilisé à des fins néfastes ne leur est venue à l’esprit que trop tard.

"Faire ces choses pour la consommation publique met les survivants en danger, et nous devons réfléchir aux conséquences imprévues."

La confidentialité et la sécurité doivent être intégrées dans une application dès le début, a déclaré Rachel Gibson, spécialiste principale de la sécurité technologique pour le Réseau national pour mettre fin à la violence domestique. "C'est une chose que quelque chose soit construit avec de bonnes intentions, mais nous savons que la technologie peut être utilisée à mauvais escient", a déclaré Gibson à Digital Trends. « Nous y pensons comme à une nouvelle technologie, à un vieux comportement. Les gens étaient encore violés dans les taxis [avant Uber], mais nous devons réfléchir à la manière dont la technologie d’aujourd’hui peut faciliter d’anciens comportements comme le harcèlement et les agressions.

Selon Gibson, quelque chose comme Clearview, même s'il a son utilité pour les forces de l'ordre, soulève certainement des questions quant à savoir comment et pourquoi il serait utile au grand public. « Faire ces choses pour la consommation publique met les survivants en danger, et nous devons réfléchir aux conséquences imprévues », a-t-elle déclaré.

La justice a déclaré qu’elle voyait le débat sur le rôle de la technologie dans la sécurité publique changer. « Le discours a changé depuis MeToo », dit-elle. « Et il était temps aussi. Ce n’est pas un problème nouveau. On ne voit pas forcément une augmentation des violences conjugales, on voit qu’on en parle enfin. Et maintenant, nous pouvons inclure les éléments complexes de la façon dont la technologie en fait partie.

Gibson a également déclaré qu'elle avait eu des conversations avec plusieurs « grandes entreprises technologiques » (même si elle ne le ferait pas). précisez lequel), et ils ont déclaré qu’ils « essayaient désormais d’être attentifs » à la construction dans le respect de la vie privée et sécurité.

Clearview a fait une brève déclaration à Digital Trends, affirmant qu'ils "prenaient ces préoccupations au sérieux et n'avaient pas l'intention de sortir commercialement". Dans un article de blog, la société a souligné que son produit n’était pas accessible au public et qu’il serait mis à la disposition « uniquement des forces de l’ordre et de certains professionnels de la sécurité ».

Si vous pensez que vous ou quelqu'un que vous connaissez souffrez de violence conjugale, contactez la ligne d'assistance nationale contre la violence domestique 24h/24 et 7j/7 au 1−800−799−7233.

Recommandations des rédacteurs

- Des commentaires basés sur l'IA arriveront à Wimbledon le mois prochain

- Elon Musk met en place un projet d'IA générative sur Twitter, selon un rapport

- Google Smart Canvas obtient une intégration plus approfondie entre les applications

- Nvidia loue sa plateforme AI Superpod pour 90 000 $ par mois

- Portland interdit l'utilisation privée et publique de la technologie de reconnaissance faciale