L'intelligence artificielle générale, l'idée d'une IA intelligente. Un agent capable de comprendre et d’apprendre n’importe quelle tâche intellectuelle que les humains peuvent accomplir fait depuis longtemps partie de la science-fiction. Comme l’I.A. devient de plus en plus intelligent, en particulier grâce aux percées des outils d'apprentissage automatique capables de réécrire leur code pour apprendre de nouvelles expériences - cela fait de plus en plus largement partie des véritables conversations sur l'intelligence artificielle à mesure que Bien.

Contenu

- Construire des mondes

- Règles du jeu

- Les choses difficiles sont faciles, les choses faciles sont difficiles

Mais comment mesurer l’AGI lorsqu’il arrive? Au fil des années, les chercheurs ont présenté un certain nombre de possibilités. Le plus célèbre reste le test de Turing, dans lequel un juge humain interagit, sans être vu, à la fois avec des humains et une machine, et doit essayer de deviner lequel est lequel. Deux autres, Robot College Student Test de Ben Goertzel et Nils J. Le test d’emploi de Nilsson vise à tester pratiquement les capacités d’une IA en voyant si elle pourrait obtenir un diplôme universitaire ou occuper un emploi. Un autre, que j’aimerais personnellement ignorer, postule que l’intelligence peut être mesurée par la capacité à assembler sans problème des meubles en kit de style Ikea.

Vidéos recommandées

L'une des mesures AGI les plus intéressantes a été proposée par le co-fondateur d'Apple, Steve Wozniak. Woz, comme l'appellent ses amis et admirateurs, suggère le Coffee Test. Une intelligence générale, dit-il, signifierait un robot capable d'entrer dans n'importe quelle maison du monde, de localiser la cuisine, de préparer une nouvelle tasse de café, puis de la verser dans une tasse.

En rapport

- Une IA analogique? Ça paraît fou, mais ça pourrait être l'avenir

- Voici ce qu’une IA analysant les tendances pense que ce sera la prochaine grande nouveauté en matière de technologie

- L’avenir de l’IA: 4 grandes choses à surveiller dans les prochaines années

Comme pour toute I.A. test d'intelligence, vous pouvez discuter de l'étendue ou de l'étroitesse des paramètres. Cependant, l’idée selon laquelle l’intelligence devrait être liée à la capacité de naviguer dans le monde réel est intrigante. C’est également un projet qu’un nouveau projet de recherche cherche à tester.

Construire des mondes

"Ces dernières années, l'A.I. La communauté a fait d'énormes progrès dans la formation de l'IA. agents pour effectuer des tâches complexes », Luca Weihs, chercheur scientifique à l'Allen Institute for AI, un laboratoire d'intelligence artificielle fondé par le regretté cofondateur de Microsoft, Paul Allen, a déclaré à Digital Trends.

Weihs a cité le développement de l’IA par DeepMind. des agents capables d'apprendre à jouer à des jeux Atari classiques et battre des joueurs humains au Go. Cependant, Weihs a noté que ces tâches sont « souvent détachées » de notre monde. Montrez une image du monde réel à une IA. formé pour jouer aux jeux Atari, et il n’aura aucune idée de ce qu’il regarde. C’est ici que les chercheurs de l’Allen Institute pensent avoir quelque chose à offrir.

L'Institut Allen pour l'IA a construit une sorte d’empire immobilier. Mais il ne s’agit pas tant d’immobilier physique que d’immobilier virtuel. Il a développé des centaines de pièces et d’appartements virtuels – notamment des cuisines, des chambres, des salles de bains et des salons – dans lesquels l’IA les agents peuvent interagir avec des milliers d’objets. Ces espaces présentent une physique réaliste, prennent en charge plusieurs agents et même des états comme chaud et froid. En laissant A.I. Les agents jouent dans ces environnements, l’idée est qu’ils puissent construire une perception plus réaliste du monde.

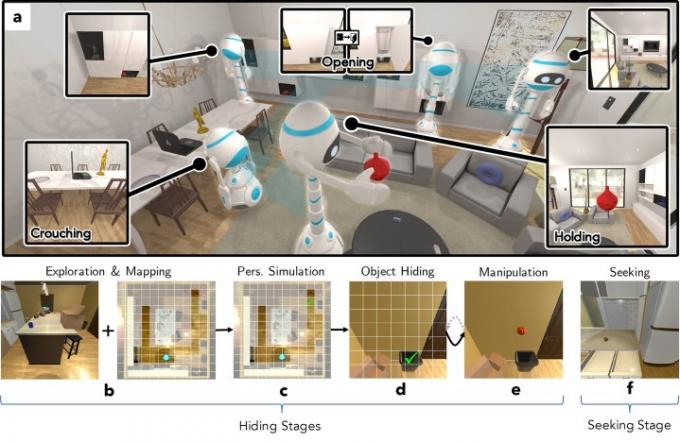

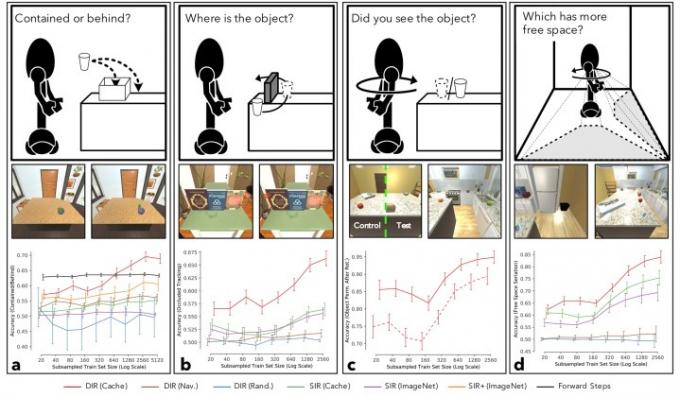

« Dans [notre nouveau] travail, nous voulions comprendre comment l’IA. les agents pourraient en apprendre davantage sur un environnement réaliste en y jouant à un jeu interactif », a déclaré Weihs. « Pour répondre à cette question, nous avons formé deux agents à jouer au Cache, une variante du jeu de cache-cache, en utilisant l'apprentissage par renforcement contradictoire dans le cadre de la haute fidélité. Environnement AI2-THOR. Grâce à ce gameplay, nous avons constaté que nos agents apprenaient à représenter des images individuelles, se rapprochant ainsi de la performance des méthodes. nécessitant des millions d'images étiquetées à la main - et a même commencé à développer certaines primitives cognitives souvent étudiées par les [développementaux] psychologues. »

Règles du jeu

Contrairement aux jeux de cache-cache classiques, dans Cache, les robots cachent à tour de rôle des objets tels que des ventouses de toilettes, des miches de pain, des tomates, etc., chacun possédant sa propre géométrie. Les deux agents – l’un cacheur, l’autre chercheur – s’affrontent ensuite pour voir si l’un parvient à cacher l’objet à l’autre. Cela implique un certain nombre de défis, notamment l'exploration et la cartographie, la compréhension de la perspective, la dissimulation, la manipulation d'objets et la recherche. Tout est simulé avec précision, jusqu'à l'exigence selon laquelle le cacheur doit pouvoir manipuler l'objet dans sa main et ne pas le laisser tomber.

Utiliser l’apprentissage par renforcement profond – un paradigme d’apprentissage automatique basé sur l’apprentissage de l’action de manière environnement pour maximiser la récompense - les robots parviennent de mieux en mieux à cacher les objets, ainsi qu'à rechercher les sortir.

"Ce qui rend les choses si difficiles pour les IA, c'est qu'elles ne voient pas le monde de la même manière que nous", a déclaré Weihs. «Des milliards d'années d'évolution ont permis à notre cerveau, même en tant que nourrisson, de traduire efficacement les photons en concepts. D’un autre côté, une I.A. part de zéro et voit son monde comme une immense grille de nombres qu’il doit ensuite apprendre à décoder pour lui donner un sens. De plus, contrairement aux échecs, où le monde est clairement contenu dans 64 cases, chaque image vue par l'agent ne capture qu'un petite partie de l'environnement, et doit donc intégrer ses observations au fil du temps pour former une compréhension cohérente de l'environnement. monde."

Pour être clair, ce dernier travail ne vise pas à créer une IA ultra-intelligente. Dans des films comme Terminator 2: Jour du Jugement, le supercalculateur Skynet prend conscience de lui-même à 2 h 14 précises, heure de l'Est, le 29 août 1997. Malgré la date, qui date maintenant de près d’un quart de siècle dans notre rétroviseur collectif, il semble peu probable qu’il y ait un point de basculement aussi précis lorsque l’IA régulière deviendra opérationnelle. devient AGI. Au lieu de cela, de plus en plus de fruits informatiques – à portée de main et à portée de main – seront cueillis jusqu’à ce que nous ayons enfin quelque chose qui se rapproche d’une intelligence généralisée dans plusieurs domaines.

Les choses difficiles sont faciles, les choses faciles sont difficiles

Les chercheurs se sont traditionnellement concentrés sur les problèmes complexes liés à l’IA. à résoudre en partant de l’idée que, si les problèmes difficiles peuvent être résolus, les plus faciles ne devraient pas être trop loin derrière. Si vous pouvez simuler la prise de décision d'un adulte, des idées comme la permanence des objets (l'idée que les objets existent quand on ne peut pas les voir) qu’un enfant apprend au cours des premiers mois de sa vie prouvent réellement que difficile? La réponse est oui – et ce paradoxe selon lequel, lorsqu’il s’agit d’IA, le les choses difficiles sont souvent faciles, et les choses faciles sont difficiles, c’est l’objectif d’un travail comme celui-ci.

« Le paradigme le plus courant pour la formation de l’IA. Les agents [impliquent] d’énormes ensembles de données étiquetés manuellement et étroitement concentrés sur une seule tâche – par exemple, reconnaître des objets », a déclaré Weihs. « Bien que cette approche ait connu un grand succès, je pense qu’il est optimiste de croire que nous pouvons créer manuellement suffisamment d’ensembles de données pour produire une analyse d’IA. agent capable d’agir intelligemment dans le monde réel, de communiquer avec les humains et de résoudre toutes sortes de problèmes qu’il n’a jamais rencontrés auparavant. Pour ce faire, je pense que nous devrons laisser les agents apprendre les primitives cognitives fondamentales que nous tenons pour acquises en les laissant interagir librement avec leur monde. Notre travail montre que l’utilisation du gameplay pour motiver l’IA. les agents avec lesquels interagir et explorer leur monde les amènent à commencer à apprendre ces primitives - et montre ainsi que le gameplay est une direction prometteuse loin des ensembles de données manuellement marqués et vers l'expérientiel apprentissage."

UN article décrivant ce travail sera présenté lors de la prochaine Conférence internationale 2021 sur les représentations de l’apprentissage.

Recommandations des rédacteurs

- Les illusions d'optique pourraient nous aider à construire la prochaine génération d'IA

- La formule amusante: pourquoi l'humour généré par la machine est le Saint Graal de l'IA.

- Lisez les « écritures synthétiques » étrangement belles d’un IA. qui pense que c'est Dieu

- Architecture algorithmique: Faut-il laisser l’IA concevoir des bâtiments pour nous?

- L'IA qui détecte les émotions est là, et cela pourrait être lors de votre prochain entretien d'embauche