Ennakoiva poliisitoiminta sen piti muuttaa tapaa, jolla poliisitoimintaa harjoitettiin, ja johdatti meidät älykkäiden lakien maailmaan täytäntöönpano, jossa puolueellisuus poistettiin ja poliisi voisi vastata tietoihin, ei aavistuksia. Mutta vuosikymmen sen jälkeen, kun useimmat meistä kuulivat ensimmäisen kerran termin "ennustava poliisitoiminta", näyttää selvältä, että se ei ole toiminut. Julkisen vastareaktion vetämänä teknologian käyttö on vähentynyt merkittävästi verrattuna vain muutaman vuoden takaiseen.

Sisällys

- Ennakoivan poliisitoiminnan lupaus

- Syrjivät algoritmit

- Likaisen datan vaarat

- Ennakoivan poliisitoiminnan epävarma tulevaisuus

- Väärät työkalut työhön?

Tämän vuoden huhtikuussa Los Angeles - joka LA Timesin mukaan "edisti rikosten ennustamista datalla" - leikkasi ennakoivan poliisiohjelmansa rahoitusta syyttämällä kustannuksia. "Se on vaikea päätös", poliisipäällikkö Michel Moore kertoi LA Timesille. "Se on strategia, jota käytimme, mutta kustannusarviot ovat satoja tuhansia dollareita käytettäväksi tähän oikeuteen minun on tehtävä nyt verrattuna sen rahan löytämiseen ja sen ohjaamiseen muihin keskeisempiin toimintoihin."

Suositellut videot

Mikä meni vikaan? Kuinka jokin "älykkääksi" teknologiaksi mainostettu voi saada aikaan entisestään juurtuvaa ennakkoluuloja ja syrjintää? Ja onko unelma ennakoivasta poliisitoiminnasta sellainen, jota voitaisiin muokata oikealla algoritmilla – vai onko se umpikuja oikeudenmukaisemmassa yhteiskunnassa, joka kamppailee parhaillaan poliisin toimintatapojen kanssa?

Ennakoivan poliisitoiminnan lupaus

Ennakoiva poliisitoiminta nykyisessä muodossaan juontaa juurensa noin vuosikymmenen taakse psykologi Colleen McCuen ja Los Angelesin poliisipäällikön Charlie Beckin vuonna 2009 julkaisemaan artikkeliin "Ennakoiva poliisitoiminta: Mitä voimme oppia Walmartilta ja Amazonilta rikosten torjunnasta taantuman aikana?Lehdessä he tarttuivat tapaan, jolla suuret jälleenmyyjät käyttivät big dataa auttaakseen paljastamaan aiemman asiakkaiden käyttäytymisen malleja, joita voitaisiin käyttää tulevan käyttäytymisen ennustamiseen. Sekä tietojenkäsittelyn että tiedonkeruun edistymisen ansiosta McCue ja Beck ehdottivat, että rikostietoja oli mahdollista kerätä ja analysoida reaaliajassa. Näitä tietoja voitaisiin sitten käyttää ennakoimaan, ehkäisemään ja reagoimaan tehokkaammin rikoksiin, joita ei ole vielä tapahtunut.

Sen jälkeisten vuosien aikana ennakoiva poliisitoiminta on siirtynyt poisheitetystä ideasta todellisuudeksi monissa osissa Yhdysvaltoja, samoin kuin muualla maailmassa. Prosessin aikana se on pyrkinyt muuttamaan poliisitoiminnan reagoivasta voimasta ennakoivaksi; hyödyntää joitakin tietopohjaisen teknologian läpimurtoja, jotka mahdollistavat kuvioiden havaitsemisen reaaliajassa – ja toimien niiden mukaan.

"Ennakoivaa poliisitoimintaa on kaksi päämuotoa" Andrew Ferguson, oikeustieteen professori District of Columbian yliopistossa David A. Clarke School of Law ja kirjoittaja Big Data Poliisin nousu: valvonta, rotu ja lainvalvonnan tulevaisuus, kertoi Digital Trendsille. "[Nämä ovat] paikkaperusteista ennakoivaa poliisitoimintaa ja henkilökohtaista ennakoivaa poliisitoimintaa."

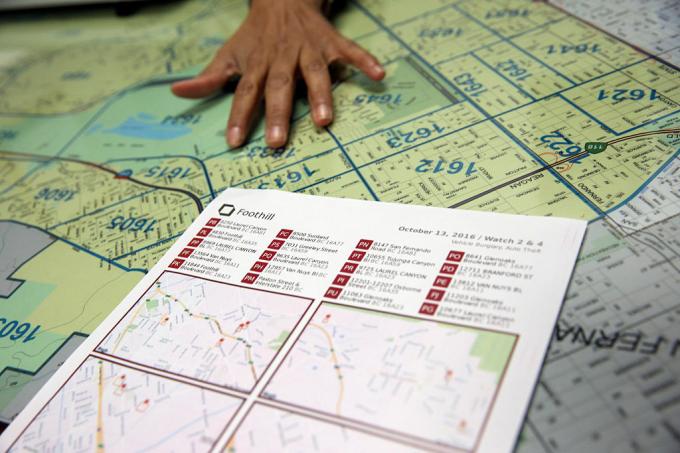

Molemmissa tapauksissa ennustavat poliisijärjestelmät antavat riskipisteen kyseiselle henkilölle tai paikalle, mikä rohkaisee poliisia seuraamaan tietyin väliajoin. Ensimmäinen näistä lähestymistavoista, paikkaperusteinen ennakoiva poliisitoiminta, keskittyy pääasiassa poliisipartioihin. Siinä käytetään rikoskartoitusta ja analytiikkaa tulevien rikosten todennäköisistä paikoista aikaisempien tilastojen perusteella.

Sen sijaan, että ennakoiva poliisitoiminta auttaisi pääsemään eroon rasismista ja muista systeemisistä ennakkoluuloista, se voi itse asiassa auttaa juurruttamaan niitä.

Toinen lähestymistapa keskittyy ennustamaan todennäköisyyttä, että yksilö aiheuttaa mahdollisen tulevan riskin. Esimerkiksi vuonna 2013 Chicagon poliisin komentaja lähetettiin 22-vuotiaan Robert McDanielin kotiin, jonka an. oli ilmoittanut mahdolliseksi aseväkivallan riskitekijäksi tai tekijäksi Chicagon keskustassa algoritmi. Algoritmin kokoamisen auttanut "lämpölista" etsi malleja, jotka voisivat ennustaa tulevat rikolliset tai uhreja, vaikka he eivät itse olisi tehneet mitään tämän tarkastelun takaamiseksi a profiili.

Kuten Chicago Tribune huomautti: "Strategia vaatii varoittamaan kuumuuslistalla olevia yksitellen, että rikollinen toiminta jatkuu, jopa kaikkein pienimmistä rikoksista, seurauksena on lain täyden voiman kumoaminen niitä."

Ennakoivan poliisitoiminnan unelma oli, että toimimalla määrällisesti mitattavissa olevien tietojen perusteella se tekisi poliisitoiminnasta paitsi tehokkaamman, myös vähemmän alttiita arvauksille ja sen seurauksena harhaan. Kannattajat väittivät, että se muuttaisi poliisitoimintaa parempaan suuntaan ja käynnistäisi uuden älykkään poliisitoiminnan aikakauden. Ennakoivalla poliisitoiminnalla on kuitenkin lähes alusta lähtien ollut ankaria kriitikkoja. He väittävät, että sen sijaan, että ennakoiva poliisitoiminta auttaisi pääsemään eroon rasismista ja muista systeemisistä ennakkoluuloista, se voi itse asiassa auttaa heitä juurtumaan. Ja on vaikea väittää, ettei heillä olisi järkeä.

Syrjivät algoritmit

Ajatus siitä, että koneoppimiseen perustuvat ennakoivat poliisijärjestelmät voivat oppia syrjimään tekijöiden, kuten rodun, perusteella, ei ole mikään uusi. Koneoppimistyökaluja koulutetaan valtavien tietojoukkojen avulla. Ja niin kauan kuin tiedot kerätään järjestelmässä, jossa rotu on edelleen ylivoimainen tekijä, se voi johtaa syrjintään.

Kuten Renata M. O'Donnell kirjoittaa vuoden 2019 paperissa, jonka otsikko on "Rasististen ennakoivien poliisitoimialgoritmien haastaminen yhtäläisen suojalausekkeen nojalla”, koneoppimisalgoritmit oppivat tiedoista, jotka on saatu oikeusjärjestelmästä, jossa ”mustia amerikkalaisia vangitaan osavaltion vankiloissa nopeudella se on 5,1 kertaa valkoisten vankeus, ja joka kolmas nykyään syntynyt musta mies voi odottaa joutuvansa vankilaan elämänsä aikana, jos nykytrendit jatkaa."

"Data ei ole objektiivista", Ferguson kertoi Digital Trendsille. "Se on vain pelkistetty binäärikoodiksi. Tietoihin perustuvat järjestelmät, jotka toimivat todellisessa maailmassa, eivät ole objektiivisempia, oikeudenmukaisempia tai puolueettomia kuin todellinen maailma. Jos todellinen maailmasi on rakenteellisesti epätasa-arvoinen tai rodullisesti syrjivä, dataohjattu järjestelmä heijastaa näitä yhteiskunnallisia eriarvoisuuksia. Sisään menevät syötteet ovat vääristymän pilaamia. Analyysi on vääristynyt. Ja poliisivallan mekanismit eivät muutu vain siksi, että järjestelmiä ohjaa teknologia."

Ferguson antaa esimerkin pidätyksistä yhtenä näennäisen objektiivisena tekijänä riskin ennustamisessa. Pidätyksiä vääristävät kuitenkin poliisin resurssien jakaminen (kuten se, missä he partioivat) ja rikostyypit, jotka tyypillisesti edellyttävät pidätyksiä. Tämä on vain yksi esimerkki mahdollisesti ongelmallisista tiedoista.

Likaisen datan vaarat

Puuttuvia ja virheellisiä tietoja kutsutaan joskus tiedon louhinnassa "likaiseksi dataksi". A 2019-paperi A.I.:n tutkijoilta. Nyt New Yorkin yliopiston instituutti laajentaa tämän termin viittaamaan myös tietoihin, joihin vaikuttaa korruptoitunut, puolueellinen ja laiton käytännöt – onko kyseessä tahallinen manipulointi, joka on vääristynyt yksilöiden ja yhteiskunnallisia ennakkoluuloja. Se voi sisältää esimerkiksi tietoja, jotka syntyvät sellaisen syyttömän henkilön pidätyksestä, jolle on istutettu todisteita tai jota on muuten aiheettomasti syytetty.

On tiettyä ironiaa siinä, että viime vuosikymmeninä tietoyhteiskunnan vaatimukset, joissa kaikki koskee kvantifiointia ja valurautaisia numeerisia tavoitteita, on juuri johtanut moniin… no, todellakin huonot tiedot. HBO-sarja Lanka esitteli todellisen "tilastojen jukkaamisen" ilmiötä, ja vuodet sen jälkeen, kun ohjelma päättyi, ovat tarjonneet paljon esimerkkejä todellisesta järjestelmällisestä tietojen manipuloinnista, väärennetyistä poliisiraporteista ja perustuslain vastaisista käytännöistä, jotka ovat lähettäneet viattomia ihmisiä vankilaan.

Huono data, jonka ansiosta vallanpitäjät voivat osua keinotekoisesti kohteisiin, on yksi asia. Mutta yhdistä se algoritmeihin ja ennustaviin malleihin, jotka käyttävät tätä pohjana maailman mallintamiseen, ja saatat saada jotain paljon pahempaa.

Tutkijat ovat osoittaneet, kuinka kyseenalaiset rikostiedot, jotka on liitetty ennakoiviin poliisialgoritmeihin, voivat luoda niin sanotun "karanneet palautesilmukat”, jossa poliiseja lähetetään toistuvasti samoille alueille todellisesta rikollisuudesta riippumatta. Yksi tuon lehden kirjoittajista, tietojenkäsittelytieteilijä Suresh Venkatasubramanian, sanoo, että koneoppimismallit voivat rakentaa virheellisiä oletuksia mallinnuksensa kautta. Kuten vanha sanonta siitä, kuinka vasaraa käyttävälle henkilölle jokainen ongelma näyttää naulalta, nämä järjestelmät mallintavat ongelman vain tiettyjä elementtejä - ja kuvittelevat vain yhden mahdollisen tuloksen.

"[Jotain], jota ei käsitellä näissä malleissa, on se, missä määrin mallinat sitä tosiasiaa, että enemmän poliiseja heittämällä alueelle voi itse asiassa heikentää siellä asuvien ihmisten elämänlaatua?" Utahin yliopiston tietojenkäsittelylaitoksen professori Venkatasubramanian kertoi Digitalille Trendit. "Olemme, että enemmän poliiseja on parempi asia. Mutta kuten nyt näemme, poliisien lisääminen ei välttämättä ole hyvä asia. Se voi itse asiassa pahentaa asioita. Yhdessäkään mallissa, jonka olen koskaan nähnyt, kukaan ei ole koskaan kysynyt, mitä maksaa lisää poliiseja alueelle.

Ennakoivan poliisitoiminnan epävarma tulevaisuus

Ennakoivassa poliisitoiminnassa työskentelevät käyttävät joskus epäironisesti termiä "vähemmistöraportti" viitatakseen siihen, millaista ennustusta he tekevät. Termiä käytetään usein viittauksena Vuoden 2002 samanniminen elokuva, joka puolestaan perustui löyhästi Philip K.:n vuoden 1956 novelliin. Dick. Sisään Vähemmistöraportti, erityinen PreCrime-poliisiosasto ottaa kiinni rikollisia perustuen ennakkotietoon tulevista rikoksista. Nämä ennusteet tarjoavat kolme psyykkiä, joita kutsutaan "prekogiksi".

Mutta käänne sisään Vähemmistöraportti että ennusteet eivät aina pidä paikkaansa. Yhden esikogin eriävät visiot tarjoavat vaihtoehtoisen näkemyksen tulevaisuudesta, joka tukahdutetaan, koska pelätään, että järjestelmä näyttää epäluotettavalta.

Sisäiset tarkastukset, jotka osoittavat taktiikan, eivät toimineet. Ennustavat luettelot eivät olleet vain virheellisiä, vaan ne olivat myös tehottomia.

Ennakoiva poliisitoiminta on tällä hetkellä oman epävarman tulevaisuutensa edessä. Uusien teknologioiden, kuten kasvojentunnistuksen, rinnalla lainvalvontaviranomaisten käytettävissä oleva tekniikka mahdollista käyttöä varten ei ole koskaan ollut tehokkaampaa. Samaan aikaan tietoisuus ennakoivan poliisitoiminnan käytöstä on aiheuttanut julkista vastareaktiota, joka on saattanut itse asiassa auttaa sen tukahduttamisessa. Ferguson kertoi Digital Trendsille, että ennakoivien poliisityökalujen käyttö on ollut "laskussa" muutaman viime vuoden ajan.

Huipussaan [paikkaperusteinen ennakoiva poliisitoiminta] oli yli 60 suuressa kaupungissa ja kasvussa, mutta seurauksena onnistunutta yhteisöorganisaatiota, sitä on suurelta osin vähennetty ja/tai korvattu muilla tietopohjaisilla muodoilla analytiikka", hän sanoi. ”Lyhyesti sanottuna termi ennakoiva poliisitoiminta kasvoi myrkyttömäksi, ja poliisilaitokset oppivat nimeämään uudelleen, mitä he tekivät datalla. Henkilökohtaisen ennakoivan poliisitoiminnan lasku oli jyrkempää. Kaksi suurinta sen luomiseen investoinutta kaupunkia - Chicago ja Los Angeles - luopuivat henkilökohtaisista sijoituksistaan strategioita terävän yhteisön kritiikin ja tuhoisten sisäisten tarkastusten jälkeen, jotka osoittavat, että taktiikka ei toiminut tehdä työtä. Ennustavat luettelot eivät vain olleet virheellisiä, vaan ne olivat myös tehottomia."

Väärät työkalut työhön?

Kuitenkin, Rashida Richardson, A.I.:n politiikan tutkimuksen johtaja Now Institute sanoi, että tämän tekniikan käyttö on liian epäselvää. "Emme vieläkään tiedä, koska julkisen teknologian ja monien hankintojen läpinäkyvyys puuttuu olemassa olevien hankintamenettelyjen porsaanreikiä, jotka voivat suojata tietyt teknologiahankinnat julkiselta valvonnalta." hän sanoi. Hän antaa esimerkin teknologiasta, joka voidaan antaa poliisilaitokselle ilmaiseksi tai ostaa kolmannen osapuolen toimesta. "Tiedämme kaltaisistani tutkimuksista ja tiedotusvälineistä, että monet Yhdysvaltain suurimmista poliisiosastoista ovat käyttäneet teknologiaa jossain vaiheessa, mutta monet pienet poliisilaitokset käyttävät sitä tai ovat käyttäneet sitä rajoitetun ajan ajasta."

Kun otetaan huomioon nykyiset poliisin roolia koskevat kysymykset, tuleeko houkutusta omaksua uudelleen Ennakoiva poliisitoiminta datapohjaisen päätöksenteon työkaluna – ehkä vähemmän dystopistisen scifin alla brändäys? On olemassa mahdollisuus, että tällainen elpyminen voi ilmaantua. Mutta Venkatasubramanian suhtautuu erittäin skeptisesti siihen, että koneoppiminen, kuten tällä hetkellä harjoitetaan, on oikea työkalu työhön.

”Koneoppimisen kokonaisuus ja sen menestys modernissa yhteiskunnassa perustuu oletukseen, että olipa tilanne mikä tahansa Ongelmana on viime kädessä tietojen kerääminen, mallin rakentaminen, tulosten ennustaminen – eikä sinun tarvitse huolehtia toimialueesta." hän sanoi. "Voit kirjoittaa saman koodin ja käyttää sitä 100 eri paikassa. Se on abstraktion ja siirrettävyyden lupaus. Ongelmana on, että kun käytämme sitä, mitä ihmiset kutsuvat sosioteknisiksi järjestelmiksi, joissa ihmiset ja teknologia ovat kietoutuneet monimutkaisiin aaltoihin, et voi tehdä tätä. Et voi vain kytkeä palaa ja odottaa sen toimivan. Koska [on] aaltoiluvaikutuksia tuon kappaleen laittamiseen ja se, että niitä on erilaisia pelaajat, joilla on erilaiset agendat tällaisessa järjestelmässä, ja he alistavat järjestelmän omiin tarpeisiinsa eri tavoilla. Kaikki nämä asiat on otettava huomioon, kun puhut tehokkuudesta. Kyllä, voit sanoa abstraktisti, että kaikki toimii hyvin, mutta siellä On ei abstraktia. On vain konteksti, jossa työskentelet."