Προγνωστική αστυνόμευση υποτίθεται ότι θα μεταμόρφωσε τον τρόπο με τον οποίο διεξήχθη η αστυνόμευση, εισάγοντάς μας σε έναν κόσμο έξυπνου νόμου επιβολής του νόμου κατά την οποία αφαιρέθηκε η μεροληψία και η αστυνομία θα μπορούσε να ανταποκριθεί στα δεδομένα και όχι σε προαισθήσεις. Αλλά μια δεκαετία αφότου οι περισσότεροι από εμάς ακούσαμε για πρώτη φορά τον όρο «προγνωστική αστυνόμευση», φαίνεται ξεκάθαρο ότι δεν λειτούργησε. Καθοδηγούμενη από μια δημόσια αντίδραση, η τεχνολογία παρουσιάζει σημαντική μείωση στη χρήση της, σε σύγκριση με μόλις πριν από λίγα χρόνια.

Περιεχόμενα

- Η υπόσχεση της προγνωστικής αστυνόμευσης

- Διακρίσιμοι αλγόριθμοι

- Οι κίνδυνοι των βρώμικων δεδομένων

- Το αβέβαιο μέλλον της προγνωστικής αστυνόμευσης

- Τα λάθος εργαλεία για τη δουλειά;

Τον Απρίλιο του τρέχοντος έτους, το Λος Άντζελες - το οποίο, σύμφωνα με τους LA Times, «πρωτοστάτησε στην πρόβλεψη του εγκλήματος με δεδομένα» - έκοψε τη χρηματοδότηση για το πρόγραμμα πρόβλεψης αστυνόμευσης, κατηγορώντας το κόστος. «Αυτή είναι μια δύσκολη απόφαση», είπε ο αρχηγός της αστυνομίας Μισέλ Μουρ

είπε στους LA Times. «Είναι μια στρατηγική που χρησιμοποιήσαμε, αλλά οι προβλέψεις κόστους εκατοντάδων χιλιάδων δολαρίων για να δαπανηθούν σε αυτό το δικαίωμα Τώρα, αντί να βρω αυτά τα χρήματα και να τα κατευθύνω σε άλλες πιο κεντρικές δραστηριότητες είναι αυτό που πρέπει να κάνω».Προτεινόμενα βίντεο

Τι πήγε στραβά? Πώς θα μπορούσε κάτι που διαφημίζεται ως «έξυπνη» τεχνολογία να περιορίσει περαιτέρω τις προκαταλήψεις και τις διακρίσεις; Και είναι το όνειρο της προγνωστικής αστυνόμευσης ένα όνειρο που θα μπορούσε να τροποποιηθεί με τον σωστό αλγόριθμο - ή ένα αδιέξοδο σε μια δικαιότερη κοινωνία που αυτή τη στιγμή παλεύει με τον τρόπο λειτουργίας της αστυνομίας;

Η υπόσχεση της προγνωστικής αστυνόμευσης

Η προγνωστική αστυνόμευση με τη σημερινή της μορφή χρονολογείται περίπου μια δεκαετία σε μια εργασία του 2009 από την ψυχολόγο Colleen McCue και τον αρχηγό της αστυνομίας του Λος Άντζελες Charlie Beck, με τίτλο "Προγνωστική αστυνόμευση: Τι μπορούμε να μάθουμε από τη Walmart και την Amazon σχετικά με την καταπολέμηση του εγκλήματος σε μια ύφεση;Στο έγγραφο, κατάλαβαν τον τρόπο με τον οποίο τα μεγάλα δεδομένα χρησιμοποιούνταν από τους μεγάλους λιανοπωλητές για να βοηθήσουν στην αποκάλυψη προτύπων συμπεριφοράς πελατών στο παρελθόν που θα μπορούσαν να χρησιμοποιηθούν για την πρόβλεψη της μελλοντικής συμπεριφοράς. Χάρη στην πρόοδο τόσο στους υπολογιστές όσο και στη συλλογή δεδομένων, οι McCue και Beck πρότειναν ότι ήταν δυνατή η συλλογή και ανάλυση δεδομένων εγκλήματος σε πραγματικό χρόνο. Αυτά τα δεδομένα θα μπορούσαν στη συνέχεια να χρησιμοποιηθούν για την πρόβλεψη, την πρόληψη και την αποτελεσματικότερη απάντηση σε εγκλήματα που δεν είχαν ακόμη λάβει χώρα.

Στα χρόνια που ακολούθησαν, η προγνωστική αστυνόμευση έχει μετατραπεί από μια ιδέα άχρηστη σε μια πραγματικότητα σε πολλά μέρη των Ηνωμένων Πολιτειών, μαζί με τον υπόλοιπο κόσμο. Στην πορεία, έχει βάλει στόχο να αλλάξει την αστυνόμευση από μια αντιδραστική δύναμη σε μια προληπτική. αντλώντας από ορισμένες από τις ανακαλύψεις στην τεχνολογία που βασίζεται σε δεδομένα που καθιστούν δυνατό τον εντοπισμό μοτίβων σε πραγματικό χρόνο — και την εφαρμογή τους.

«Υπάρχουν δύο κύριες μορφές προγνωστικής αστυνόμευσης», Άντριου Φέργκιουσον, καθηγητής Νομικής στο Πανεπιστήμιο της Περιφέρειας της Κολούμπια Ντέιβιντ Α. Clarke School of Law και συγγραφέας του Η άνοδος της αστυνόμευσης μεγάλων δεδομένων: επιτήρηση, φυλή και το μέλλον της επιβολής του νόμου, είπε στο Digital Trends. «[Πρόκειται για προγνωστική αστυνόμευση βάσει τόπου και προγνωστική αστυνόμευση βάσει ατόμου».

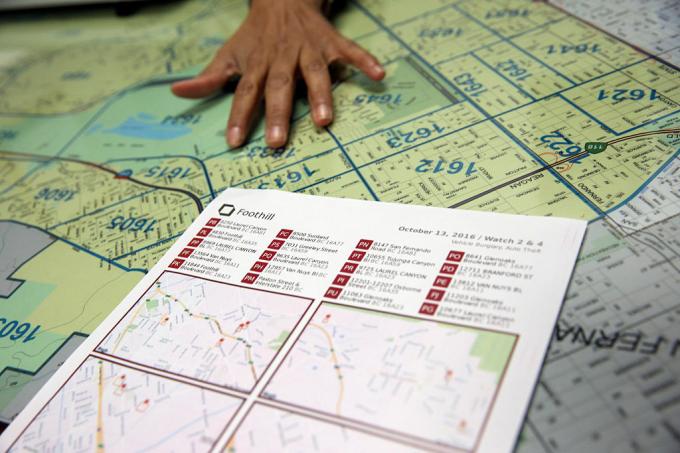

Και στις δύο περιπτώσεις, τα συστήματα πρόβλεψης αστυνόμευσης αποδίδουν μια βαθμολογία κινδύνου στο εν λόγω άτομο ή μέρος, κάτι που ενθαρρύνει την αστυνομία να παρακολουθεί σε ένα δεδομένο διάστημα. Η πρώτη από αυτές τις προσεγγίσεις, η προγνωστική αστυνόμευση βάσει τόπου, εστιάζει κυρίως στις αστυνομικές περιπολίες. Περιλαμβάνει τη χρήση χαρτογράφησης εγκλημάτων και αναλύσεων σχετικά με τους πιθανούς τόπους μελλοντικών εγκλημάτων, με βάση προηγούμενα στατιστικά στοιχεία.

Αντί να βοηθά να απαλλαγούμε από προβλήματα όπως ο ρατσισμός και άλλες συστημικές προκαταλήψεις, η προγνωστική αστυνόμευση μπορεί στην πραγματικότητα να βοηθήσει στην εδραίωση τους.

Η δεύτερη προσέγγιση εστιάζει στην πρόβλεψη της πιθανότητας ότι ένα άτομο θέτει έναν πιθανό μελλοντικό κίνδυνο. Για παράδειγμα, το 2013, ένας διοικητής της αστυνομίας του Σικάγο στάλθηκε στο σπίτι ενός 22χρονου Robert McDaniel, ο οποίος είχε επισημανθεί ως πιθανός κίνδυνος ή δράστης ένοπλης βίας στο κέντρο της πόλης του Σικάγο από έναν αλγόριθμος. Η «λίστα θερμότητας» που βοήθησε στη συναρμολόγηση ο αλγόριθμος αναζητούσε μοτίβα που θα μπορούσαν να είναι σε θέση να προβλέψουν μελλοντικούς παραβάτες ή θύματα, ακόμα κι αν τα ίδια δεν είχαν κάνει τίποτα που να δικαιολογεί αυτόν τον έλεγχο πέρα από τη συμμόρφωση με Προφίλ.

Όπως το Σημείωσε η Chicago Tribune: «Η στρατηγική απαιτεί να προειδοποιούνται μεμονωμένα όσοι βρίσκονται στη λίστα θερμότητας ότι περαιτέρω εγκληματική δραστηριότητα, ακόμη και για τα πιο ασήμαντα αδικήματα, θα καταργηθεί η πλήρης ισχύς του νόμου τους."

Το όνειρο της προγνωστικής αστυνόμευσης ήταν ότι, ενεργώντας βάσει μετρήσιμων δεδομένων, θα έκανε την αστυνόμευση όχι μόνο πιο αποτελεσματική, αλλά και λιγότερο επιρρεπή σε εικασίες και, ως αποτέλεσμα, μεροληψία. Όπως ισχυρίστηκαν οι υποστηρικτές, θα άλλαζε την αστυνόμευση προς το καλύτερο και θα εγκαινίαζε μια νέα εποχή έξυπνης αστυνόμευσης. Ωστόσο, σχεδόν από την αρχή, η προγνωστική αστυνόμευση είχε ένθερμους επικριτές. Υποστηρίζουν ότι, αντί να βοηθά στην απαλλαγή από προβλήματα όπως ο ρατσισμός και άλλες συστημικές προκαταλήψεις, η προγνωστική αστυνόμευση μπορεί στην πραγματικότητα να βοηθήσει στην εδραίωση τους. Και είναι δύσκολο να υποστηρίξουμε ότι δεν έχουν νόημα.

Διακρίσιμοι αλγόριθμοι

Η ιδέα ότι τα συστήματα πρόβλεψης αστυνόμευσης που βασίζονται στη μηχανική μάθηση μπορούν να μάθουν να κάνουν διακρίσεις με βάση παράγοντες όπως η φυλή δεν είναι κάτι καινούργιο. Τα εργαλεία μηχανικής μάθησης εκπαιδεύονται με τεράστιες σβώλους δεδομένων. Και, εφόσον αυτά τα δεδομένα συλλέγονται από ένα σύστημα στο οποίο η φυλή εξακολουθεί να αποτελεί συντριπτικό παράγοντα, αυτό μπορεί να οδηγήσει σε διακρίσεις.

Όπως είπε η Ρενάτα Μ. Ο O'Donnell γράφει σε μια εφημερίδα του 2019, με τίτλο "Πρόκληση αλγόριθμων ρατσιστικής πρόβλεψης αστυνόμευσης βάσει της ρήτρας ίσης προστασίας», οι αλγόριθμοι μηχανικής μάθησης μαθαίνουν από δεδομένα που προέρχονται από ένα σύστημα δικαιοσύνης στο οποίο «οι μαύροι Αμερικανοί φυλακίζονται σε κρατικές φυλακές σε ποσοστό δηλαδή 5,1 φορές τη φυλάκιση των λευκών, και ένας στους τρεις μαύρους που γεννιούνται σήμερα μπορεί να περιμένει να πάει φυλακή στη ζωή του, αν υπάρχουν οι τρέχουσες τάσεις να συνεχίσει."

«Τα δεδομένα δεν είναι αντικειμενικά», είπε ο Ferguson στο Digital Trends. «Απλώς έχουμε περιοριστεί σε δυαδικό κώδικα. Τα συστήματα που βασίζονται σε δεδομένα και λειτουργούν στον πραγματικό κόσμο δεν είναι πιο αντικειμενικά, δίκαια ή αμερόληπτα από τον πραγματικό κόσμο. Εάν ο πραγματικός κόσμος σας είναι δομικά άνισος ή εισάγει φυλετικές διακρίσεις, ένα σύστημα που βασίζεται σε δεδομένα θα αντικατοπτρίζει αυτές τις κοινωνικές ανισότητες. Οι εισροές που εισέρχονται είναι μολυσμένες από προκατάληψη. Η ανάλυση είναι μολυσμένη από μεροληψία. Και οι μηχανισμοί της αστυνομικής εξουσίας δεν αλλάζουν μόνο και μόνο επειδή υπάρχει τεχνολογία που καθοδηγεί τα συστήματα».

Ο Ferguson δίνει το παράδειγμα των συλλήψεων ως έναν φαινομενικά αντικειμενικό παράγοντα για την πρόβλεψη του κινδύνου. Ωστόσο, οι συλλήψεις θα παραμορφωθούν λόγω της κατανομής των αστυνομικών πόρων (όπως εκεί όπου περιπολούν) και των τύπων εγκλημάτων που συνήθως δικαιολογούν συλλήψεις. Αυτό είναι μόνο ένα παράδειγμα δυνητικά προβληματικών δεδομένων.

Οι κίνδυνοι των βρώμικων δεδομένων

Τα ελλιπή και λανθασμένα δεδομένα αναφέρονται μερικές φορές στην εξόρυξη δεδομένων ως "βρώμικα δεδομένα". ΕΝΑ Έργο 2019 από ερευνητές από το A.I. Τώρα Ινστιτούτο στο Πανεπιστήμιο της Νέας Υόρκης επεκτείνει αυτόν τον όρο για να αναφέρεται επίσης σε δεδομένα που επηρεάζονται από διεφθαρμένα, μεροληπτικά και παράνομα πρακτικές — είτε αυτές προέρχονται από σκόπιμα χειραγώγηση που παραμορφώνονται από άτομα και κοινωνικές προκαταλήψεις. Θα μπορούσε, για παράδειγμα, να περιλαμβάνει δεδομένα που προκύπτουν από τη σύλληψη ενός αθώου ατόμου στο οποίο έχουν τοποθετηθεί αποδεικτικά στοιχεία ή που κατηγορείται με άλλον τρόπο ψευδώς.

Υπάρχει μια κάποια ειρωνεία στο γεγονός ότι, τις τελευταίες δεκαετίες, οι απαιτήσεις της κοινωνίας των δεδομένων, στην οποία τα πάντα έχουν να κάνουν με την ποσοτικοποίηση και τους χυτοσίδηρους αριθμητικούς στόχους, μόλις οδήγησαν σε πάρα πολλά… καλά, πραγματικά κακά δεδομένα. Η σειρά του HBO Το σύρμα παρουσίασε το πραγματικό φαινόμενο του «πραγματικού πειράματος των στατιστικών» και τα χρόνια από τότε που η εκπομπή βγήκε στον αέρα έχουν προσφέρει πολλά παραδείγματα πραγματικής συστημικής χειραγώγησης δεδομένων, πλαστών αστυνομικών αναφορών και αντισυνταγματικών πρακτικών που έχουν στείλει αθώους ανθρώπους σε φυλακή.

Τα κακά δεδομένα που επιτρέπουν στους ανθρώπους στην εξουσία να χτυπούν τεχνητά στόχους είναι ένα πράγμα. Αλλά συνδυάστε το με αλγόριθμους και μοντέλα πρόβλεψης που χρησιμοποιούν αυτό ως βάση για τη μοντελοποίηση του κόσμου και δυνητικά θα έχετε κάτι πολύ χειρότερο.

Οι ερευνητές έχουν δείξει πώς τα αμφίβολα δεδομένα εγκληματικότητας που συνδέονται σε αλγόριθμους πρόβλεψης αστυνόμευσης μπορούν να δημιουργήσουν αυτό που αναφέρεται ως "δραπέτες βρόχους ανατροφοδότησης», στο οποίο η αστυνομία στέλνεται επανειλημμένα στις ίδιες γειτονιές, ανεξάρτητα από το πραγματικό ποσοστό εγκληματικότητας. Ένας από τους συν-συγγραφείς αυτού του άρθρου, επιστήμονας υπολογιστών Suresh Venkatasubramanian, λέει ότι τα μοντέλα μηχανικής μάθησης μπορούν να δημιουργήσουν λανθασμένες υποθέσεις μέσω της μοντελοποίησής τους. Όπως το παλιό ρητό για το πώς, για το άτομο με ένα σφυρί, κάθε πρόβλημα μοιάζει με καρφί, αυτά τα συστήματα μοντελοποιούν μόνο ορισμένα στοιχεία ενός προβλήματος — και φαντάζονται μόνο ένα πιθανό αποτέλεσμα.

«[Κάτι που] δεν αντιμετωπίζεται σε αυτά τα μοντέλα είναι σε ποιο βαθμό διαμορφώνετε το γεγονός ότι η ρίψη περισσότερων αστυνομικών σε μια περιοχή μπορεί στην πραγματικότητα χαμηλότερη ποιότητα ζωής για τους ανθρώπους που ζουν εκεί;». Ο Venkatasubramanian, καθηγητής στη Σχολή Πληροφορικής στο Πανεπιστήμιο της Γιούτα, είπε στην Digital Τάσεις. «Υποθέτουμε ότι περισσότεροι αστυνομικοί είναι καλύτερο πράγμα. Αλλά όπως βλέπουμε αυτή τη στιγμή, το να έχεις περισσότερη αστυνομία δεν είναι απαραίτητα καλό. Μπορεί πραγματικά να κάνει τα πράγματα χειρότερα. Σε κανένα μοντέλο που έχω δει ποτέ κανείς δεν ρώτησε ποτέ ποιο είναι το κόστος της τοποθέτησης περισσότερων αστυνομικών σε μια περιοχή».

Το αβέβαιο μέλλον της προγνωστικής αστυνόμευσης

Εκείνοι που εργάζονται στην προγνωστική αστυνόμευση χρησιμοποιούν μερικές φορές ειρωνικά τον όρο «Αναφορά μειοψηφίας» για να αναφερθούν στο είδος της πρόβλεψης που κάνουν. Ο όρος επικαλείται συχνά ως αναφορά στο Ομώνυμη ταινία του 2002, το οποίο με τη σειρά του βασίστηκε χαλαρά σε ένα διήγημα του 1956 του Philip K. Ψωλή. Σε Εκθεση μειονότητας, ένα ειδικό αστυνομικό τμήμα PreCrime συλλαμβάνει εγκληματίες με βάση την πρόγνωση των εγκλημάτων που πρόκειται να διαπραχθούν στο μέλλον. Αυτές οι προβλέψεις παρέχονται από τρία μέντιουμ που ονομάζονται «precogs».

Αλλά η ανατροπή Εκθεση μειονότητας είναι ότι οι προβλέψεις δεν είναι πάντα ακριβείς. Τα αντίθετα οράματα ενός από τους προκαταρκτικούς οδηγούς παρέχουν μια εναλλακτική άποψη για το μέλλον, η οποία καταστέλλεται από φόβο μήπως το σύστημα φαίνεται αναξιόπιστο.

Οι εσωτερικοί έλεγχοι που δείχνουν ότι οι τακτικές δεν λειτούργησαν. Όχι μόνο οι λίστες πρόβλεψης ήταν ελαττωματικές, αλλά ήταν και αναποτελεσματικές.

Αυτή τη στιγμή, η προγνωστική αστυνόμευση αντιμετωπίζει το δικό της αβέβαιο μέλλον. Εκτός από τις νέες τεχνολογίες όπως η αναγνώριση προσώπου, η τεχνολογία που είναι διαθέσιμη στις αρχές επιβολής του νόμου για πιθανή χρήση δεν ήταν ποτέ πιο ισχυρή. Ταυτόχρονα, η ευαισθητοποίηση σχετικά με τη χρήση της προγνωστικής αστυνόμευσης έχει προκαλέσει μια δημόσια αντίδραση που μπορεί στην πραγματικότητα να βοήθησε στην εξάλειψή της. Ο Φέργκιουσον είπε στο Digital Trends ότι η χρήση εργαλείων πρόβλεψης αστυνόμευσης βρίσκεται σε «πτωτική τάση» τα τελευταία χρόνια.

«Στο ζενίθ της, [η προγνωστική αστυνόμευση βάσει τόπου] ήταν σε περισσότερες από 60 μεγάλες πόλεις και αυξανόταν, αλλά ως αποτέλεσμα επιτυχής κοινοτική οργάνωση, έχει σε μεγάλο βαθμό μειωθεί και ή αντικατασταθεί με άλλες μορφές δεδομένων αναλυτικά», είπε. «Εν ολίγοις, ο όρος προγνωστική αστυνόμευση έγινε τοξικός και τα αστυνομικά τμήματα έμαθαν να μετονομάζουν αυτό που έκαναν με τα δεδομένα. Η προγνωστική αστυνόμευση με βάση τα άτομα είχε μια πιο απότομη πτώση. Οι δύο κύριες πόλεις που επένδυσαν στη δημιουργία του - το Σικάγο και το Λος Άντζελες - υποστήριξαν την προσωπική τους βάση στρατηγικές μετά από έντονη κριτική της κοινότητας και καταστροφικούς εσωτερικούς ελέγχους που δείχνουν ότι οι τακτικές δεν το έκαναν δουλειά. Όχι μόνο οι λίστες πρόβλεψης ήταν ελαττωματικές, ήταν επίσης αναποτελεσματικές».

Τα λάθος εργαλεία για τη δουλειά;

Ωστόσο, Ρασίντα Ρίτσαρντσον, Διευθυντής Πολιτικής Έρευνας στο Α.Ι. Τώρα το Ινστιτούτο είπε ότι υπάρχει υπερβολική αδιαφάνεια σχετικά με τη χρήση αυτής της τεχνολογίας. «Ακόμα δεν γνωρίζουμε λόγω της έλλειψης διαφάνειας σχετικά με την απόκτηση τεχνολογίας από την κυβέρνηση και πολλά κενά στις υφιστάμενες διαδικασίες προμήθειας που ενδέχεται να προστατεύσουν ορισμένες αγορές τεχνολογίας από τον δημόσιο έλεγχο, είπε. Δίνει το παράδειγμα της τεχνολογίας που μπορεί να δοθεί σε ένα αστυνομικό τμήμα δωρεάν ή να αγοραστεί από τρίτο μέρος. «Γνωρίζουμε από έρευνες όπως η δική μου και τα μέσα ενημέρωσης που αναφέρουν ότι πολλά από τα μεγαλύτερα αστυνομικά τμήματα στις ΗΠΑ έχουν χρησιμοποιήσει το τεχνολογία κάποια στιγμή, αλλά υπάρχουν και πολλά μικρά αστυνομικά τμήματα που τη χρησιμοποιούν ή την έχουν χρησιμοποιήσει για περιορισμένα χρονικά διαστήματα χρονικός."

Δεδομένης της τρέχουσας αμφισβήτησης για τον ρόλο της αστυνομίας, θα υπάρξει πειρασμός να ξανααγκαλιάσουμε η προγνωστική αστυνόμευση ως εργαλείο για τη λήψη αποφάσεων βάσει δεδομένων — ίσως κάτω από λιγότερο δυστοπική επιστημονική φαντασία branding; Υπάρχει η πιθανότητα να εμφανιστεί μια τέτοια αναζωπύρωση. Αλλά ο Venkatasubramanian είναι πολύ δύσπιστος ότι η μηχανική μάθηση, όπως εφαρμόζεται σήμερα, είναι το κατάλληλο εργαλείο για τη δουλειά.

«Το σύνολο της μηχανικής μάθησης και η επιτυχία της στη σύγχρονη κοινωνία βασίζεται στην προϋπόθεση ότι, ανεξάρτητα από την πραγματική πρόβλημα, τελικά καταλήγει στη συλλογή δεδομένων, στη δημιουργία ενός μοντέλου, στην πρόβλεψη του αποτελέσματος — και δεν χρειάζεται να ανησυχείτε για τον τομέα." αυτός είπε. «Μπορείτε να γράψετε τον ίδιο κώδικα και να τον εφαρμόσετε σε 100 διαφορετικά μέρη. Αυτή είναι η υπόσχεση της αφαίρεσης και της φορητότητας. Το πρόβλημα είναι ότι όταν χρησιμοποιούμε αυτό που οι άνθρωποι αποκαλούν κοινωνικο-τεχνικά συστήματα, όπου οι άνθρωποι και η τεχνολογία μπλέκονται σε περίπλοκα κύματα, δεν μπορείτε να το κάνετε αυτό. Δεν μπορείτε απλώς να συνδέσετε ένα κομμάτι και να περιμένετε ότι θα λειτουργήσει. Επειδή [υπάρχουν] κυματιστικά εφέ με την τοποθέτηση αυτού του κομματιού και το γεγονός ότι υπάρχουν διαφορετικά παίκτες με διαφορετικές ατζέντες σε ένα τέτοιο σύστημα και ανατρέπουν το σύστημα στις δικές τους ανάγκες διαφορετικοί τρόποι. Όλα αυτά τα πράγματα πρέπει να λαμβάνονται υπόψη όταν μιλάτε για αποτελεσματικότητα. Ναι, μπορείς να πεις αφηρημένα ότι όλα θα λειτουργήσουν καλά, αλλά εκεί είναι όχι αφηρημένη. Υπάρχει μόνο το πλαίσιο στο οποίο εργάζεστε».