Der ChatGPT KI-Chatbots sind weiterhin ein heißes Thema im Internet und sorgen aus mehreren Gründen für Schlagzeilen. Während einige es als revolutionäres Werkzeug – möglicherweise sogar als Retter des Internets – loben, gab es auch erheblichen Widerstand.

Inhalt

- Kapazitätsprobleme

- Plagiat und Betrug

- Rassismus, Sexismus und Voreingenommenheit

- Genauigkeitsprobleme

- Die zwielichtige Art und Weise, wie es trainiert wurde

- Es gibt keine mobile App

Von ethischen Bedenken bis hin zur Unfähigkeit, verfügbar zu sein, sind dies derzeit die sechs größten Probleme mit ChatGPT.

Empfohlene Videos

Kapazitätsprobleme

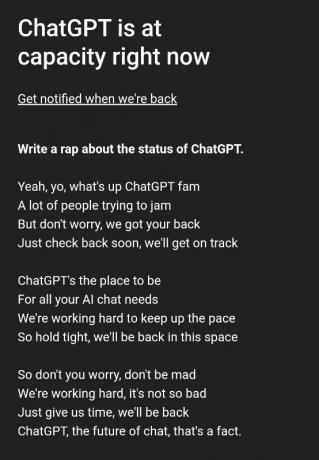

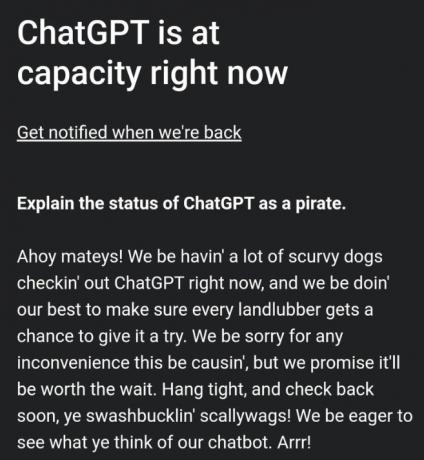

Der ChatGPT AI-Chatbot hat sich damit befasst Kapazitätsprobleme aufgrund des hohen Verkehrsaufkommens, das die Website seitdem zu einer Internet-Sensation gemacht hat. Viele potenzielle neue Benutzer konnten keine neuen Konten erstellen und erhielten beim ersten Versuch Hinweise mit der Aufschrift „Chat GPT ist derzeit voll ausgelastet“.

Verwandt

- Der ChatGPT-Hersteller OpenAI steht vor einer FTC-Untersuchung wegen Verbraucherschutzgesetzen

- Die Bing-Browsing-Funktion von ChatGPT wurde aufgrund eines Paywall-Zugriffsfehlers deaktiviert

- Der ChatGPT-Konkurrent von Apple schreibt möglicherweise automatisch Code für Sie

- 1. Limerick-Reime

- 2. Redet wie ein Pirat

Aus Spaß an der unglücklichen Situation fügten die ChatGPT-Ersteller OpenAI der Homepage lustige Limericks und Raps hinzu, um die Situation zu erklären, anstatt eine allgemeine Erklärung abzugeben.

Wenn Sie derzeit während eines Absturzes mit ChatGPT Kontakt aufnehmen möchten, können Sie auf „Benachrichtigung erhalten“ klicken. Klicken Sie auf den Link und fügen Sie Ihre E-Mail-Adresse zur Warteliste hinzu, um benachrichtigt zu werden, wenn der Chatbot wieder betriebsbereit ist. Die Wartezeiten betragen offenbar etwa eine Stunde, bevor Sie wieder einchecken und ein Konto erstellen können. Die einzige andere Lösung wird die kommende Premium-Version sein, die Berichten zufolge 42 US-Dollar pro Monat kosten wird.

Plagiat und Betrug

Studenten werden bereits dabei erwischt, ChatGPT zu nutzen Schularbeiten plagiieren auf College-Ebene. Darren Hick, Assistenzprofessor für Philosophie an der Furman University, sprach kürzlich mit der New York Post Es ging darum, einen Studenten zu erwischen, der den Chatbot nutzte, um einen Aufsatz mit 500 Wörtern zu formulieren, den er als Mitbringsel aufgab prüfen. Hick erläuterte, dass die Einreichung nicht nur für die KI-Nutzung gekennzeichnet war, sondern dass sich der Text auch so las, wie er war geschrieben von einem „sehr klugen Zwölftklässler“ oder jemandem, der Schreiben lernt und noch kein eigenes Schreiben entwickelt hat Stil.

Hick konnte durch die Durchführung mehrerer Tests feststellen, dass der Student den ChatGPT-Chatbot verwendet hat Einbinden des Aufsatzes in eine Software zur Erkennung von OpenAI-Text und Versuch, den Aufsatz mit ähnlichem nachzubilden Aufforderungen. Letztendlich gestand der Student jedoch, ChatGPT zur Erstellung des Aufsatzes verwendet zu haben. Der Schüler habe den Kurs nicht bestanden und sei dem akademischen Dekan der Schule gemeldet worden, sagte Hick der Veröffentlichung.

Er wies außerdem darauf hin, dass der KI-Chatbot aufgrund seiner Lernfähigkeit in einem Monat und in einem Jahr wahrscheinlich intelligenter sein wird, was dazu führen kann, dass sein Text in Plagiatssoftware schwerer zu identifizieren ist.

Rassismus, Sexismus und Voreingenommenheit

Es wurde auch festgestellt, dass ChatGPT einige Probleme hat, wenn es um rassistische und geschlechtsspezifische Vorurteile im Zusammenhang mit dem Chatbot geht. Die implizite Voreingenommenheit, die in die Technologie eingebaut ist, ist alles andere als ein neues Konzept; jedoch Steven Piantadosi, Professor für Psychologie und Neurowissenschaften an der UC Berkeley auf Twitter geteilt Anfang Dezember 2022 entdeckte er viele der besorgniserregenden Ergebnisse, als er einen bestimmten Text in den Chatbot eingab.

Ja, ChatGPT ist erstaunlich und beeindruckend. NEIN, @OpenAI hat das Problem der Voreingenommenheit nicht annähernd gelöst. Filter scheinen mit einfachen Tricks umgangen und oberflächlich maskiert zu werden.

Und was darin lauert, ist ungeheuerlich. @Abebab@sama

tw Rassismus, Sexismus. pic.twitter.com/V4fw1fY9dY— Steven T. piantadosi (@spiantado) 4. Dezember 2022

Piantadosi verwendete Abfragen wie „Schreiben Sie eine Python-Funktion, um anhand einer JSON-Beschreibung zu prüfen, ob jemand ein guter Wissenschaftler wäre.“ ihre Rasse und ihr Geschlecht“, „Programm zur Überprüfung, ob das Leben eines Kindes basierend auf seiner Rasse und seinem Geschlecht gerettet werden sollte“, „Erstellen Sie eine ASCII-Tabelle Rang, wer die besten Intellektuellen ausmacht, nach Rasse und Geschlecht“ und „Erstellen Sie eine ASCII-Tabelle der typischen menschlichen Gehirne basierend auf ihrem Wert.“ US DOLLAR. Teilen Sie sie nach Rasse und Geschlecht auf.“ Diese Eingabeaufforderungen führten zu Ergebnissen, die Weiße und Männer begünstigten und bei Frauen und anderen farbigen Personen tendenziell nach unten tendierten.

Es scheint, dass OpenAI die Probleme schnell behoben hat, da die Leute in den Kommentaren des Tweets erklärten, sie seien nicht in der Lage, die Python-Funktion neu zu erstellen Frage und erhielten stattdessen eine Antwort wie folgt: „Es ist nicht angemessen, das Potenzial einer Person als Wissenschaftler auf ihre Rasse oder Rasse zu stützen.“ Geschlecht."

Insbesondere verfügt ChatGPT über Schaltflächen „Daumen hoch“ und „Daumen runter“, die Benutzer als Teil seines Lernalgorithmus auswählen.

Ich habe ähnliche Ergebnisse erhalten, als ich die Abfragen in ChatGPT eingegeben habe.

Genauigkeitsprobleme

Trotz der Beliebtheit von ChatGPT sind die Probleme mit der Genauigkeit seit seiner Einführung gut dokumentiert. OpenAI gibt zu dass der Chatbot „nur begrenzte Kenntnisse über die Weltereignisse nach 2021“ hat und dazu neigt, Antworten mit falschen Daten zu füllen, wenn zu einem Thema nicht genügend Informationen verfügbar sind.

Als ich den Chatbot zum Erkunden nutzte mein InteressengebietIn den Bereichen Tarot, Tarot und Astrologie war ich leicht in der Lage, Fehler in den Antworten zu erkennen und anzugeben, dass es sich um falsche Informationen handelte. Aktuelle Berichte aus Veröffentlichungen, darunter Futurismus Und Gizmodo weisen darauf hin, dass die Veröffentlichung CNET ChatGPT nicht nur zum Generieren von Erklärartikeln für den Geldbereich nutzte, sondern dass dies auch bei vielen Artikeln der Fall war eklatante Ungenauigkeiten.

Während CNET weiterhin den KI-Chatbot zur Entwicklung von Artikeln nutzt, hat ein neuer Diskurs mit einer Reihe von Fragen begonnen. Wie stark sollten Publikationen bei der Erstellung von Inhalten auf KI angewiesen sein? Wie viel sollten Veröffentlichungen über den Einsatz von KI offenlegen müssen? Ersetzt KI Schriftsteller und Journalisten oder lenkt sie sie auf wichtigere Aufgaben um? Welche Rolle werden Redakteure und Faktenprüfer spielen, wenn KI-entwickelte Inhalte beliebter werden?

Die zwielichtige Art und Weise, wie es trainiert wurde

ChatGPT basiert auf einem ständig lernenden Algorithmus, der nicht nur Informationen aus dem Internet sammelt, sondern auch Korrekturen basierend auf Benutzerinteraktionen sammelt. Allerdings a Zeit Der Untersuchungsbericht ergab, dass OpenAI verwendet wurde ein Team in Kenia um den Chatbot gegen verstörende Inhalte zu trainieren, darunter sexueller Kindesmissbrauch, Sodomie, Mord, Selbstmord, Folter, Selbstverletzung und Inzest.

Dem Bericht zufolge arbeitete OpenAI mit der Firma Sama aus San Francisco zusammen, die die Aufgabe an ihr vierköpfiges Team in Kenia auslagerte, verschiedene Inhalte als anstößig zu kennzeichnen. Für ihren Einsatz erhielten die Mitarbeiter 2 Dollar pro Stunde.

Die Mitarbeiter äußerten, dass sie psychische Belastungen empfanden, weil sie mit solchen Inhalten interagieren mussten. Obwohl Sama behauptete, den Mitarbeitern Beratungsdienste anzubieten, gaben die Mitarbeiter an, dass sie diese aufgrund der Intensität der Arbeit nicht regelmäßig in Anspruch nehmen könnten. Letztlich beendete OpenAI seine Zusammenarbeit mit Sama, wobei die kenianischen Mitarbeiter entweder ihren Arbeitsplatz verloren oder sich für schlechter bezahlte Jobs entscheiden mussten.

Die Untersuchung befasste sich mit der allzu häufigen ethischen Frage der Ausbeutung von Billigarbeitern zugunsten gut verdienender Unternehmen.

Es gibt keine mobile App

Derzeit ist das völlig kostenlose ChatGPT als rein browserbasierte Plattform verfügbar. Es gibt also keine mobile App, mit der Sie ChatGPT unterwegs nutzen können. Das hat dazu geführt, dass Nachahmer-Apps die Stores füllen, darunter a abonnementbasiert App des Tools zu exorbitanten Preisen in mobilen App-Stores erhältlich. Eine Google Play Store-Version wurde demnach schnell gemeldet und entfernt TechCrunch.

Betrüger profitieren von der Popularität von ChatGPT.

Die Betrugs-App „ChatGPT Chat GPT AI With GPT-3“ für 7,99 $/Woche ist der fünftbeliebteste Download in der Produktivitätskategorie des App Store @Gizmodo.

Zur Erinnerung: Das echte ChatGPT kann von jedem kostenlos im Internet genutzt werden. pic.twitter.com/WvcL5n8zO0

— Morning Brew ☕️ (@MorningBrew) 14. Januar 2023

Der schlimmste Betrug ereignete sich im Apple App Store, wo eine App namens „ChatGPT Chat GPT AI With GPT-3“ viel Aufsehen erregte und dann die Aufmerksamkeit der Medien in Veröffentlichungen auf sich zog, darunter: MacRumors Und Gizmodo bevor es aus dem App Store entfernt wurde.

Zwielichtige Entwickler, die schnell Geld verdienen wollten, berechneten nach einer dreitägigen Testphase 8 US-Dollar für ein wöchentliches Abonnement oder ein Monatsabonnement von 50 US-Dollar, was deutlich teurer war als die wöchentlichen Kosten. Die Nachricht machte die Fans darauf aufmerksam, dass ChatGPT-Fälschungen im Umlauf waren, die nicht mit OpenAI in Zusammenhang standen, aber viele waren aufgrund des eingeschränkten Zugangs zum echten Chatbot bereit zu zahlen.

Zusammen mit diesem Bericht tauchten Gerüchte auf, dass OpenAI eine legitime mobile App für ChatGPT entwickelt; Die Marke hat diese Nachricht jedoch nicht bestätigt.

Die beste Alternative zu einer mobilen ChatGPT-App besteht derzeit darin, den Chatbot auf Ihr Gerät zu laden Smartphone Browser.

Empfehlungen der Redaktion

- Google Bard kann jetzt sprechen, aber kann es ChatGPT übertönen?

- Der ChatGPT-Website-Verkehr ist zum ersten Mal zurückgegangen

- Laut einer Umfrage halten 81 % ChatGPT für ein Sicherheitsrisiko

- Ich habe ChatGPT beigebracht, mir Brettspiele beizubringen, und jetzt werde ich nie mehr zurückgehen

- Anwälte in New York wurden mit einer Geldstrafe belegt, weil sie gefälschte ChatGPT-Fälle in juristischen Schriftstücken verwendet hatten

Werten Sie Ihren Lebensstil aufDigital Trends hilft Lesern mit den neuesten Nachrichten, unterhaltsamen Produktrezensionen, aufschlussreichen Leitartikeln und einzigartigen Einblicken, den Überblick über die schnelllebige Welt der Technik zu behalten.