Vil du vide navnet på den blomst eller fugl, du møder under din spadseretur gennem en park? Snart vil Google Assistant være i stand til at fortælle dig det ved hjælp af kameraet og kunstig intelligens.

Anbefalede videoer

Google satte gang i 2017 I/O konference omkring AI og maskinlæring, og en computervisionsteknologi, den fremhævede, er Google Lens, som gør det muligt kameraet gør mere end blot at tage et billede - det giver større sammenhæng omkring, hvad det er, du ser.

Kommer til Google Assistant og Google Fotos, kan Google Lens-teknologien "forstå, hvad du ser på og hjælpe dig med at handle," sagde Googles administrerende direktør Sundar Pichai under keynoten. Hvis du f.eks. peger kameraet mod et koncertlokale, kan Google Assistant fortælle dig mere om optrædende, samt spille musik, hjælpe dig med at købe billetter til showet og tilføje det til din kalender, alt sammen inden for en enkelt app.

Når kameraet peger på et ukendt objekt, kan Google Assistant gennem billedgenkendelse fortælle dig, hvad det er. Peg den på et butiksskilt, og ved hjælp af lokationsoplysninger kan du give dig meningsfuld information om virksomheden. Alt dette kan gøres gennem den "samtale" stemmeinteraktion, som brugeren har med Assistant.

"Du kan pege din telefon mod den, og vi kan automatisk gøre det hårde arbejde for dig," sagde Pichai.

Med Google Lens er din smartphone Kameraet vil ikke kun se, hvad du ser, men vil også forstå, hvad du ser for at hjælpe dig med at handle. #io17pic.twitter.com/viOmWFjqk1

- Google google) 17. maj 2017

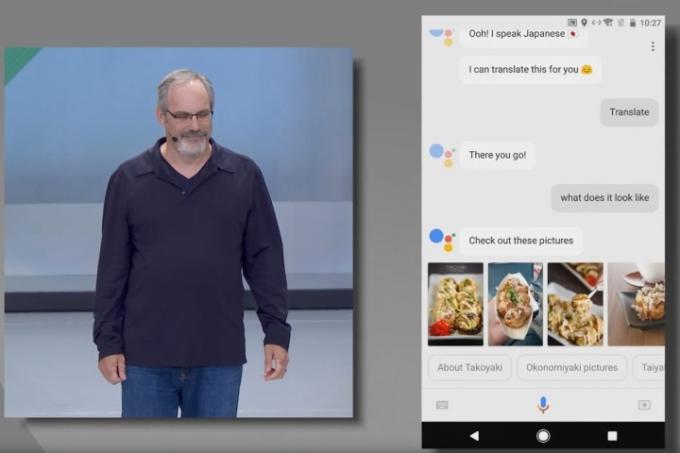

Hvis du bruger Googles Oversæt-app, har du allerede set, hvordan teknologien fungerer: Placer et kamera over noget tekst, og appen vil oversætte det til et sprog, du forstår. I Google Assistant vil Google Lens tage dette videre. I en demonstration viste Google det

Billedgenkendelsesteknologi er ikke ny, men Google Lens viser, hvordan avanceret maskinlæring er ved at blive. Pichai sagde, at som med sit arbejde med tale, ser Google store forbedringer i synet. Computer vision-teknologien hjælper ikke kun med at genkende, hvad noget er, men kan endda hjælpe med at reparere eller forbedre et billede. Tog et sløret billede af Eiffeltårnet? Fordi computeren genkender objektet og ved, hvordan det skal se ud, kan den automatisk forbedre dette billede baseret på, hvad der allerede ved.

"Vi kan forstå egenskaberne bag et billede," sagde Pichai. "Vores computersynssystemer er nu endnu bedre end mennesker til billedgenkendelse."

For at gøre Lens effektiv til sit arbejde, anvender Google en sofistikeret beregningsarkitektur af Cloud Tensor Processing Unit (TPU) chipsæt, til at håndtere træning og inferens for dens maskine læring. Dens andengenerations TPU-teknologi kan håndtere 180 billioner flydende kommaoperationer i sekundet; 64 TPU-kort i en supercomputer kan klare 11,5 petaflops. Med denne computerkraft kan den nye TPU håndtere både træning og konklusioner på samme tid, hvilket ikke var muligt i fortiden (den tidligere TPU kunne kun håndtere slutningsarbejde, men ikke det mere komplekse uddannelse). Maskinlæring tager tid, men denne hardware hjælper med at accelerere indsatsen.

Google Lens vil også drive den næste opdatering af Google Fotos. Billedgenkendelse bruges allerede i Fotos til at genkende ansigter, steder og ting for at hjælpe med organisering og søgning. Med Google Lens kan Google Fotos give dig større information om tingene på dine billeder, såsom navnet og beskrivelsen af en bygning; ved at trykke på et telefonnummer på et billede, foretages et opkald og henter flere oplysninger om et kunstværk, du så i en museum, eller endda indtast Wi-Fi-adgangskoden automatisk fra et billede, du har taget af bagsiden af en Wi-Fi router.

Assistent og Fotos vil være de første apps, der bruger Google Lens, men de vil blive rullet ud i andre apps. Og med annonceringen af support til Assistant i iOS vil iPhone-brugere også kunne bruge Google Lens-teknologien.

Redaktørens anbefalinger

- Nej, du har virkelig ikke brug for Google Assistant på dit smartwatch

- 5 ting, vi ville elske at se på Google I/O 2023 (men sandsynligvis ikke vil)

- Google I/O 2023 finder sted den 10. maj med en personlig begivenhed

- iPhone 14 Pro vs. Google Pixel 7 Pro-kamerakampen er ufatteligt tæt på

- Denne nye Google Lens-funktion ser ud som om den er lige ud af en sci-fi-film

Opgrader din livsstilDigital Trends hjælper læserne med at holde styr på den hurtige teknologiske verden med alle de seneste nyheder, sjove produktanmeldelser, indsigtsfulde redaktionelle artikler og enestående smugkig.