"Alder af A.I. er begyndt,” erklærede Nvidia CEO Jensen Huang ved dette års GTC. På sin GPU-teknologikonference i år fremviste Nvidia sin innovation for at fremme A.I., og bemærkede, hvordan teknologien kunne hjælpe med at løse verdens problemer 10 gange bedre og hurtigere.

Indhold

- Endnu en undskyldning for lanceringen af RTX 3080/3090

- Nvidia Omniverse er en træningsbane for robotter

- Nvidia RTX A6000: Strålesporing til professionelle

- Fremkomsten af A.I. bots

- A.I. for fremtiden for arbejde hjemmefra

- At bringe et datacenter til en ARM-chip

- Personlige anbefalingsmotorer

- A.I. for alt IoT

- Fremme ARM

Mens Nvidia er mest kendt for sin grafikkort — og for nylig forbundet med realtid strålesporing — virksomheden driver også innovationen bag kulisserne, der bringer kunstig intelligens ind i vores daglige liv, fra lagerrobotter der pakker vores forsendelsesordrer til selvkørende biler og bots med naturligt sprog, der leverer nyheder, søgninger og informationer med lidt forsinkelse eller forsinke.

"Vi elsker at arbejde på ekstremt hårde computerproblemer, som har stor indflydelse på verden," sagde Huang og bemærkede at virksomheden nu har 110 SDK'er, der er målrettet mod de mere end 1 milliard CUDA-kompatible GPU'er, der har været afsendt. Virksomheden siger, at mere end 6.500 startups bygger applikationer på Nvidia og slutter sig til de 2 millioner Nvidia-udviklere i alt. "Det her er lige i vores styrehus. Vi er alle i gang med at fremme og demokratisere denne nye form for databehandling til A.I. Nvidia er dedikeret til at fremme accelereret databehandling."

Relaterede

- Nvidia bringer ChatGPT-stil AI til videospil, og jeg er allerede bekymret

- Jeg pitchede min latterlige opstartside til en robot-VC

- Analog A.I.? Det lyder skørt, men det er måske fremtiden

Endnu en undskyldning for lanceringen af RTX 3080/3090

Huang førte med endnu en hurtig undskyldning om den vanskelige lancering af Nvidia RTX 3080 og 3090 videokort. Læs mere her.

Anbefalede videoer

Nvidia Omniverse er en træningsbane for robotter

For gamere,

Nvidia Omniverse, som nu er tilgængelig i åben beta, er en åben platform til samarbejde og simulering, hvor robotter kan lære af realistiske simuleringer af den virkelige verden. Ved at bruge Omniverse kan autonome køretøjer hurtigt lære at køre og interagere med virkelige scenarier menneskelige bilister kan støde på, uden risiko for at bringe tilskuere i fare, hvis forsøget går sidelæns. Omniverse giver også mulighed for test i en meget bredere skala, da et autonomt køretøj eller en robot ikke behøver at være fysisk indsat for at teste det.

For at vise, hvordan Nvidia Omniverse kan påvirke os alle, fremhævede Nvidia, hvordan Omniverse kan arbejde i lægemiddelopdagelse, som er et endnu mere vigtigt forskningsområde i betragtning af den globale pandemi. Selvom opdagelse af lægemidler typisk tager mere end et årti at udvikle adug og kræver mere end en halv milliard dollars i forsknings- og udviklingsfinansiering, mislykkes 90% af disse bestræbelser, sagde Huang. For at gøre tingene værre fordobles omkostningerne ved at opdage nye lægemidler hvert niende år.

Nvidias Omniverse kan hjælpe forskere med at identificere de proteiner, der kan forårsage sygdom, samt fremskynde testning af potentielle lægemidler ved at bruge A.I. og dataanalyse. Alt dette anvendes på Nvidias nye Clara Discovery-platform. Og i Storbritannien introducerede Nvidia sit nye Cambridge One-datacenter, som selskabet siger er det hurtigste i regionen og et af de 30 bedste i verden med 400 petaflops af A.I. ydeevne.

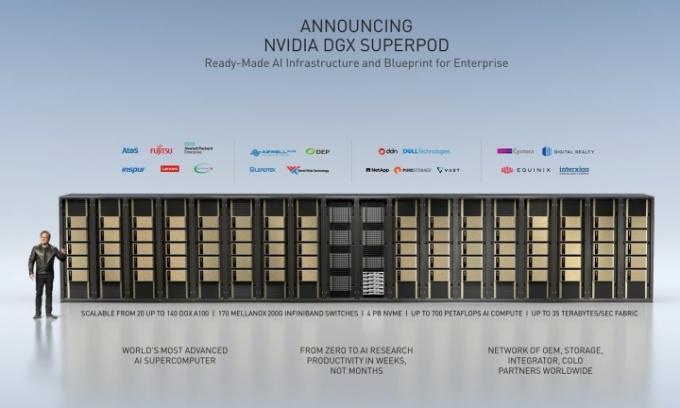

Virksomheden introducerede også sin nye DGX Super Pod-arkitektur for at give andre forskere mulighed for at bygge deres egne skalerbare supercomputere, der forbinder mellem 20 til 140 DGX systemer.

Nvidia RTX A6000: Strålesporing til professionelle

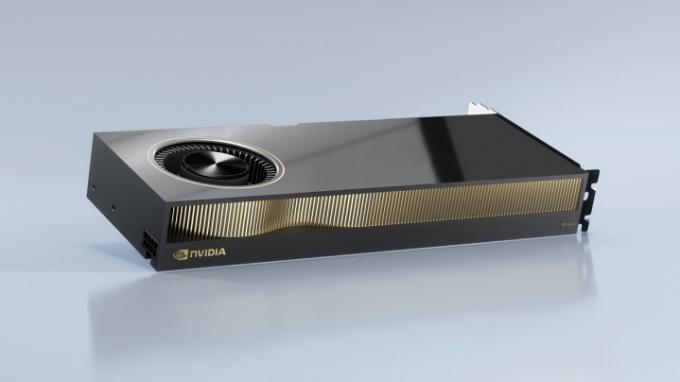

Udvider på de nyligt annoncerede GeForce RTX 3070, RTX 3080 og RTX 3090 grafikkort, annoncerede Nvidia en ny generation af Ampere-baserede GPU'er til professionelle. Den nye

"GPU'erne giver hastigheden og ydeevnen til at gøre det muligt for ingeniører at udvikle innovative produkter, designere til at skabe state-of-the-art bygninger og videnskabsmænd til at opdage gennembrud fra hvor som helst i verden," udtalte virksomheden i et blogindlæg og bemærkede, at de nye A6000 og A40 har nye RT-kerner, Tensor-kerner og CUDA-kerner, der er "væsentligt hurtigere end de tidligere generationer.”

Virksomheden gav ikke specifikke detaljer om hardwaren. Nvidia hævdede dog, at andengenerations RT-kernerne leverer 2x gennemløbet af de tidligere generationskort, mens de også giver samtidige

Kortene leveres med 48 GB GPU-hukommelse, der kan udvides til 96 GB med NVLink, når to GPU'er er forbundet. Dette sammenlignes med kun 24 GB hukommelse på RTX 3090. Mens RTX 3090 markedsføres som en GPU, der er i stand til at gengive spil i 8K med 60 billeder i sekundet (fps), udvidet hukommelse på de professionelle RTX A6000 og A40 hjælper med at behandle Blackmagic RAW 8K og 12K-optagelser til video redigering. Ligesom forbrugernes Ampere-kort er A6000 og A40 GPU'erne baseret på PCIe Gen 4, som leverer dobbelt så stor båndbredde som den tidligere generation.

De A40-baserede servere vil være tilgængelige i systemer fra Cisco, Dell, Fujitsu, Hewlett Packard Enterprise og Lenovo. A6000 GPU'erne kommer til kanalpartnere, og begge GPU'er vil være tilgængelige i begyndelsen af næste år. Prisoplysninger var ikke umiddelbart tilgængelige, og det er uklart, om de professionelle kort vil se det samme begrænset udbud og store mangler som Nvidia oplevede med lanceringen af sine forbrugerkort.

Fremkomsten af A.I. bots

Nvidia fremhævede også, hvordan dets arbejde med GPU'er er med til at fremskynde A.I. udvikling og adoption. Facebook's A.I. forskere har udviklet en chatbot med viden og empati, som halvdelen af det sociale netværks brugere faktisk foretrak. California Institute of Technology-forskere trænede en drone ved hjælp af forstærkningslæring til at styre flyvesystemet til at flyve jævnt gennem turbulens og ændringer i terræn.

Nvidias A.I. er baseret på tre søjler: Enkelt- til multi-GPU-noder på enhver ramme eller model, brug af inferens og anvendelse af fortrænede modeller, sagde Huang.

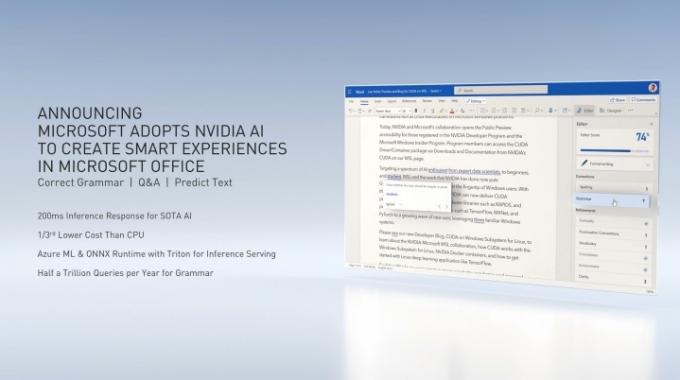

Nvidia annoncerede også, at det har indgået partnerskab med Microsoft for at bringe Nvidia A.I. til Azure for at hjælpe med at gøre Office smartere.

"I dag annoncerer vi, at Microsoft tager Nvidia A.I. på Azure, for at drive smarte oplevelser i Microsoft Office,” sagde Huang under keynoten. "Verdens mest populære produktivitetsapplikation, der bruges af hundredvis af millioner, vil nu være A.I.-støttet. De første funktioner vil omfatte smart grammatikkorrektion, Q&A, tekstforudsigelse. På grund af mængden af brugere og den øjeblikkelige respons, der er nødvendig for en god oplevelse, vil Office være forbundet til Nvidia GPU'er, og Azure med Nvidia GPU'er tager mindre end 200 millisekunder. Vores gennemstrømning lader Microsoft skalere til millioner af samtidige brugere."

American Express bruger også A.I. at bekæmpe svindel, mens Twitter udnytter kunstig intelligens til at hjælpe det med at forstå og kontekstualisere den store mængde videoer, der er uploadet til platformen.

Med samtale A.I. har resultater fra stemmeforespørgsler udført på Nvidias GPU-platform halvdelen ventetid sammenlignet med CPU-behandlede forespørgsler og også mere realistisk, menneskelignende lydende tekst-til-tale motorer. Nvidia annoncerede også en åben beta af Jarvis, så udviklere kan prøve A.I. med samtaleevner.

A.I. for fremtiden for arbejde hjemmefra

A.I. kan også indbygges i applikationer som videokonference- og chatløsninger, der hjælper medarbejderne med at samarbejde eksternt. Med Nvidias Video Maxene sagde Huang, at A.I. kan gøre magi til videoopkald.

Maxene kan identificere de vigtige funktioner i et ansigt, kun sende ændringerne af funktionerne over internettet og derefter genoplive ansigtet ved modtageren. Dette sparer båndbredde, hvilket giver en bedre videooplevelse i områder med dårlig internetforbindelse. Huang hævdede, at båndbredden er reduceret med en faktor 10.

A.I. gøre opkald bedre selv i områder med høj båndbredde, dog. I det mest ekstreme eksempel er A.I. kan bruges til at omorientere dit ansigt, så du får øjenkontakt med alle personer i et opkald, selv når dit ansigt vippes lidt væk fra kameraet. A.I. kan også reducere baggrundsstøj, genoplyse dit ansigt, erstatte baggrunden og forbedre videokvaliteten i dårlig belysning. Kombineret med Jarvis A.I. tale, kan Maxene også levere lukket billedtekst.

"Vi har en mulighed for at revolutionere videokonferencer i dag og opfinde morgendagens virtuelle tilstedeværelse," sagde Huang. "Og video A.I. slutningsapplikationer kommer fra alle brancher."

At bringe et datacenter til en ARM-chip

Nvidia fremhævede sin investering i ARM-chips og annoncerede de nye BlueField DPU'er, som bringer kraften i en datacenter-infrastruktur-på-en-chip og understøttes af DOCA, som er arkitektur.

De nye BlueField 2 DPU'er aflaster kritiske komponenter - såsom netværk og lagring - samt sikkerhedsopgaver fra CPU'en for at hjælpe med at forhindre cyberangreb.

"En enkelt BlueField-2 DPU kan levere de samme datacentertjenester, som kunne forbruge op til 125 CPU-kerner," hævdede Nvidia i en forberedt erklæring. "Dette frigør værdifulde CPU-kerner til at køre en lang række andre virksomhedsapplikationer." Virksomheden sagde, at mindst 30% af CPU'en var tidligere forbrugt af at køre datacenterinfrastruktur, og disse kerner er nu frigivet, da opgaven nu er overført til BlueField DPU.

En anden Bluefield 2X DPU kommer også med Nvidias Ampere-baseret GPU-teknologi. Ampere bringer A.I. til BlueField 2X for at levere sikkerhedsanalyser i realtid og identificere ondsindet aktivitet.

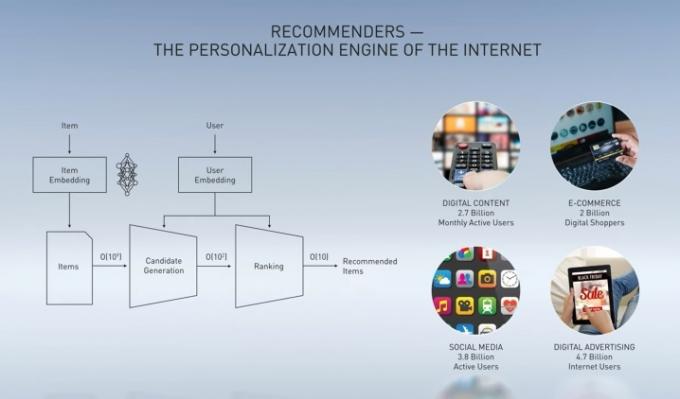

Personlige anbefalingsmotorer

A.I. kan bruges til at levere personlige anbefalinger af digitale og fysiske varer på platforme, vise relevante digitale annoncer, nyheder og film. Nvidia hævdede, at selv en forbedring på 1% i anbefalingsnøjagtighed kan beløbe sig til milliarder mere i salg og højere kundefastholdelse.

For at hjælpe virksomheder med at forbedre deres anbefalingsmotor introducerede Nvidia Merlin, som er drevet af Nvidia Rapids-platformen. Mens CPU-baserede løsninger kan tage dage at lære, siges Merlin at være superhurtige og superskalerbare, med cyklustider, der går fra en dag til kun tre timer. Merlin er nu i åben beta, sagde Huang.

Rapids bruges af Adobe til intelligent markedsføring, mens Capital One bruger platformen til svindelanalyse og til at drive virksomhedens Eno-chatbot.

A.I. for alt IoT

Nvidias EGX-platform bruges til at bringe A.I. til kant enheder for at lave A.I. mere lydhør for Internet of Things eller IoT-applikationer. EGX er tilgængelig på Nvidias NGC, og det bruges af hospitaler som Northwestern Memorial Hospital til at overføre nogle opgaver til computere, der rutinemæssigt udføres af sygeplejersker. Patienter kan for eksempel bruge naturlige sprogforespørgsler til at spørge en bot, hvilken procedure de har.

"EGX A.I. computeren integrerer en Mellanox Bluefield 2 GPU og en Ampere GPU i et enkelt PCI Express-kort, hvilket gør enhver standard OEM-server til en sikker accelereret A.I. datacenter," sagde Huang.

Platformen kan udnyttes inden for sundhedspleje, produktion, logistik, levering, detailhandel og transport.

Fremme ARM

"I dag. vi annoncerer et stort initiativ til at fremme ARM-platformen,” sagde Huang om virksomhedens annoncerede opkøb af ARM, ikke noget at det foretager investeringer i tre dimensioner.

"For det første supplerer vi ARM-partnere med GPU-, netværks-, storage- og sikkerhedsteknologier for at skabe komplette accelererede platforme. For det andet arbejder vi sammen med vores partnere om at skabe platforme til HPC cloud edge NPC. Dette kræver chipssystemer og systemsoftware. Og for det tredje porterer vi Nvidia A.I. og Nvidia RTX-motorer til ARM."

I øjeblikket er dette kun tilgængeligt på x86-platformen. Nvidias investering i ARm vil dog transformere det i forkant og accelerere det i A.I. computing, sagde Huang, da han søger at positionere ARM som en konkurrent til Intel i serverrummet.

Redaktørens anbefalinger

- Nvidias supercomputer kan bringe en ny æra af ChatGPT

- Nvidia GPU'er ser massiv prisstigning og enorm efterspørgsel fra AI

- Zooms A.I. teknologi til at opdage følelser under opkald forstyrrer kritikere

- Nvidia afslører den første CPU og Hopper GPU nogensinde på GTC 2022

- Hvordan Nvidia bruger A.I. for at hjælpe Domino's med at levere pizzaer hurtigere