Jeg har en vision om en tid, hvor jeg ikke behøver at smide en telefon ind og ud af lommen 200 gange om dagen. Jeg udsender stemmekommandoer, lige fra at afspille denne musik eller tv-show og vise mig vejret i morgen, til at give katten en ekstra snack - og det vil ske automatisk, uanset hvor jeg er. Jeg behøver ikke at angive en enhed; hvis min anmodning kræver lydfeedback eller visuel repræsentation, vil den nærmeste højttaler eller skærm komme til live. Hvis jeg vil holde pause, holder jeg bare hånden i vejret.

Indhold

- Berøringsskærmens tyranni

- Taler højt

- Den manglende brik i puslespillet

Denne idé om disembodied A.I., der sælges til os af sci-fi-film og shows som Star Trek, kommer snigende tættere på, uanset om du indser det eller ej. Sandt at sige kan jeg allerede udføre mine eksempelstemmekommandoer i mit hus, og de virker for det meste, men der er problemer med de krævede enheder, og de opfører sig ofte som fjender, der er skubbet ind i en modvillig midlertidig våbenstilstand. Alt for ofte virker noget ikke som forventet, og du er tilbage til at grave det glasrektangel frem og trykke og stryge dig vej til en løsning.

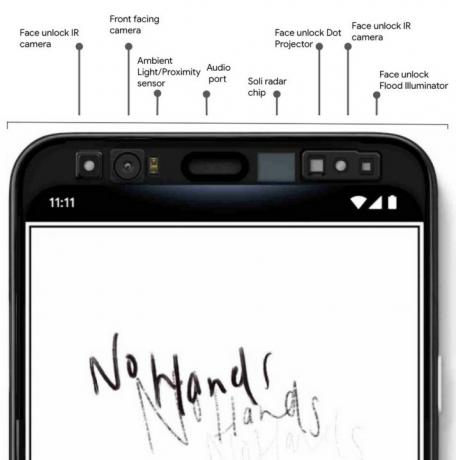

Det planlægger Google at ændre på. Firmaet bare udgivet en video viser en kvinde, der interagerer med den kommende Pixel 4 uden at røre den. Først låses telefonen op, efter at den genkender hendes ansigt - indtil videre, altså Apple - men så vifter hun med hånden for at skifte den sang, der afspilles. Vi ved, at dette er frugten af Projekt Soli, som vi først stødte på mere end fire år siden. I en nøddeskal er det miniaturiseret radar, der kan passe ind i en telefon og genkende præcise finger- og håndbevægelser. Det kan også give dig mulighed for at holde pause, skubbe lydstyrken op og ned og endda præcist navigere gennem menuer.

Du tænker måske, gjorde Samsung ikke dette med Galakse s4 og for nylig gjorde LG ikke dette med G8 ThinQ? Lidt - men Samsungs implementering var forfærdelig, og LG bruger en flyvetidssensor i stedet. Endnu vigtigere er det, at Samsung og LG ikke har Googles softwarefærdigheder eller dens bredere vision. Dette er ikke det eneste træk, Google gør for at frigøre os fra berøringsskærmen.

Berøringsskærmens tyranni

Som havne, knapper, og rammer smelter væk, vores smartphones bliver strippet tilbage til det væsentlige, men vi kan bare ikke komme væk fra den skærm. Ifølge ét studie, rører vi vores telefoner i gennemsnit 2.617 gange om dagen. Vi er konditioneret til at røre ved vores telefoner, at prioritere at reagere på dem frem for den faktiske person foran os; nogle gange mærker vi endda fantomvibrationer og reagerer på en indbildt notifikation, der aldrig har været.

Endnu vigtigere er det, at Samsung og LG ikke har Googles softwarefærdigheder eller dens bredere vision.

At låse din telefon op med dit ansigt er en friktionsfri oplevelse, og det er en af de ting, du vænner dig til meget hurtigt og savner, hvis den bliver taget væk. Vi har set bevægelser før, men de har altid været ujævne i implementeringen og begrænsede i anvendelighed. Jeg er optimistisk, at Google vil løfte denne idé til det næste niveau. Begge er vigtige trin, der reducerer vores behov for at røre ved vores telefoner, men det er kun ved at kombinere dem med stemmen, at vi virkelig kan ændre den måde, vi interagerer på.

Hvilket bringer os til en anden vigtig grund til, at Google er perfekt placeret til at levere en håndfri fremtid: Google Assistant. Det er langt den mest dygtige, funktionsrige stemmeassistent, og den forbedres med den hurtigste hastighed.

Taler højt

Det næste version af Google Assistant, som også får sin debut på Pixel 4, giver dig mulighed for at stille stribevis af spørgsmål uden at sige "Hey Google" ind imellem. Dataene er blevet krympet, så de kan passe på din telefon, så Google Assistant kan svare uden at skulle konsultere en fjern server. Den forstår konteksten, og vigtigst af alt kan den fuldføre din kommando meget, meget hurtigere, end du nogensinde kunne trykke, skrive og swipe på den.

Uanset om du vil diktere en e-mail, finde billeder af din Disneyland-rejse eller kombinere opgaver, der springer ind og ud af flere apps er brug af din stemme og Google Assistant indstillet til at blive den nemmeste og hurtigste måde at gøre det på det. Folk har været langsomme til at adoptere stemmekommandoer, dels fordi stemmeassistentens evner er begrænsede, og de ikke forstår sammenhængen, men ofte simpelthen fordi det er hurtigere at gøre det i hånden. Når det ikke længere er sandt, bliver det hele et meget mere attraktivt forslag, og efter at have brugt stemme kommandoer i et stykke tid, det er ligesom ansigtslås - hvor skift til en fingeraftrykssensor føles som et skridt baglæns.

Selvom ansigtslås og bevægelser og stemmekommandoer er spændende, ville det være for tidligt at forudsige smartphonens død. Der er tidspunkter, hvor der ikke er nogen højttaler eller skærm i din nærhed, så vores fysiske smartphones tjener stadig et vigtigt formål. Der er også tidspunkter, hvor det vil være at foretrække at stryge og trykke på en skærm frem for at tale eller bevægelser.

Jeg bruger Google Assistant hele min dag nu. Den læser mig nyhederne, giver mig vejropdateringer, minder mig om aftaler og fortæller mig, hvordan jeg kommer derhen, hvor jeg skal hen. Det besvarer også min endeløse buffet af tilfældige spørgsmål. Men lige så behageligt som jeg bruger det, og lige så begejstret som jeg er over, at det skal forbedres yderligere, har jeg stadig en tendens til at begrænse min brug til tidspunkter, hvor jeg er alene eller sammen med familien. Jeg har ikke tænkt mig at gøre det i et travlt tog eller stå i kø på kaffebaren, og det skal du heller ikke.

Der er endnu en frustrerende stopklods for en håndfri fremtid, som Google er godt placeret til at overvinde.

Den manglende brik i puslespillet

Konkurrence mellem virksomheder og stædig modstand mod integration eller fælles standarder berøver os den sci-fi-fremtid, vi fortjener. Mens Samsung og LG, og også Apple for den sags skyld, alle er fokuserede på at sælge os hardware, er Googles ambition nummer ét at være den kropsløse assistent. Jeg spekulerer nogle gange på, om flytningen fra referenceenhedens Nexus-linje til den mere forbrugerfokuserede Pixel egentlig bare var utålmodighed og voksende frustration over, at store producenter som Samsung forsøger at udvikle deres egne assistenter i stedet for at omfavne Googles.

Google er perfekt placeret til at levere en håndfri fremtid.

Som det står, kan du bygge et håndfrit setup, men hvis du vil have noget tæt på den sømløse integration imellem forskellige enheder, skal du gå all-in med en bestemt producent og blive en discipel af Apple eller en Samsung hengiven. Problemet med det er, at ingen enkelt producent tilbyder det bedste af alt, så du er nødt til at gå på kompromis et eller andet sted.

Amazon formåede at snige sig ind bagdøren ved at tillade alle og enhver at integrere Alexa, men oddsene er imod, at den vinder ud som den samlende kraft inden for tech, fordi den fuldstændig missede båden på smartphones. Google er i pole position, med smartphones syet op og få forhindringer for dets udvidelse til smart home-teknologi. Google lancerer muligvis disse nye håndfri funktioner på Pixel 4, men i modsætning til sine konkurrenter vil den langsigtede plan se dem rulle ud på enhver telefon, der er i stand til at drage fordel - kickeren er, at Google kommer sammen med dem.

Redaktørens anbefalinger

- Galaxy Z Fold 5 har brug for disse 4 ting for at slå Pixel Fold

- Kan Pixel Folds kamera slå Galaxy Z Fold 4? Jeg fandt ud af

- Google Pixel Watch 2: rygtet pris, udgivelsesdato, nyheder og mere

- Google kan skabe den perfekte Pixel-telefon - hvis den ændrer én ting

- Har du en gammel Google Pixel? Denne kameratest giver dig lyst til en Pixel 7a