The ChatGPT AI chatbot продължава да бъде гореща тема онлайн, правейки заглавия по няколко причини. Въпреки че някои го възхваляват като революционен инструмент - вероятно дори спасител на интернет - имаше и значителен отпор.

Съдържание

- Проблеми с капацитета

- Плагиатство и измама

- Расизъм, сексизъм и пристрастия

- Проблеми с точността

- Сенчестият начин, по който беше обучено

- Няма мобилно приложение

От етични опасения до невъзможността му да бъде достъпен, това са шестте най-големи проблема с ChatGPT в момента.

Препоръчани видеоклипове

Проблеми с капацитета

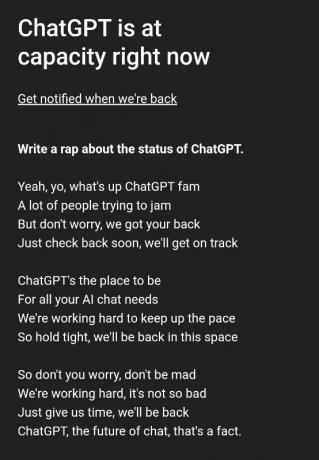

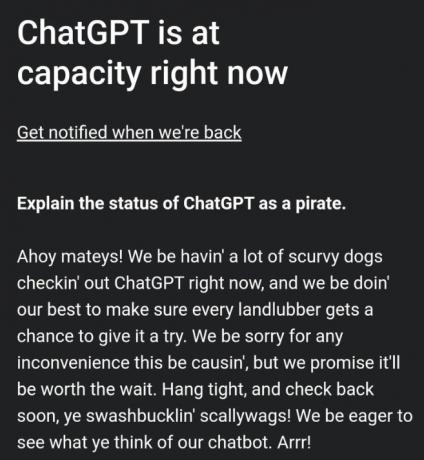

Чатботът ChatGPT AI, с който се занимава проблеми с капацитета поради голямото количество трафик, който уебсайтът му събра, откакто се превърна в интернет сензация. Много потенциални нови потребители не са успели да създадат нови акаунти и са били посрещнати с известия, които гласят „Chat GPT е с капацитет в момента“ при първия опит.

Свързани

- Създателят на ChatGPT OpenAI е изправен пред разследване на FTC относно законите за защита на потребителите

- Функцията за сърфиране в Bing на ChatGPT е деактивирана поради грешка в достъпа до платена стена

- Съперникът на Apple ChatGPT може автоматично да напише код вместо вас

- 1. Рими на лимерик

- 2. Говорейки като пират

Забавлявайки се с неприятната ситуация, създателите на ChatGPT, OpenAI добавиха забавни стихове и рапове към началната страница, за да обяснят ситуацията, вместо общ обяснител.

В момента, ако искате да продължите с ChatGPT по време на срив, можете да щракнете върху „получаване на известия“ връзка и добавете имейл адреса си към списъка с чакащи, за да бъдете предупредени, когато чатботът започне да работи отново. Времето за изчакване изглежда около един час, преди да можете да се регистрирате отново, за да създадете акаунт. Единственото друго решение ще бъде в предстоящата премиум версия, която според съобщенията ще струва $42 на месец.

Плагиатство и измама

Студентите вече са хванати да използват ChatGPT за плагиатстват училищни работи на колегиално ниво. Асистентът по философия в университета Фурман, Дарън Хик, наскоро говори с New York Post относно залавянето на ученик, който е използвал чатбота, за да формулира есе от 500 думи, което е възложил за вкъщи тест. Хик уточни, че не само подаването е маркирано за използване на AI, но и че текстът се чете така, както е бил написано от „много умен 12-класник“ или някой, който се учи да пише, който не е развил свой собствен стил.

Хик успя да определи, че ученикът е използвал чатбота ChatGPT, като изпълни няколко теста, включително включване на есето в софтуер, използван за откриване на текст на OpenAI и също опит за пресъздаване на есето с подобен подкани. В крайна сметка обаче студентът призна, че е използвал ChatGPT за изготвянето на есето. Студентът се е провалил на класа и е докладван на академичния декан на училището, каза Хик пред изданието.

Той също така отбеляза, че поради обучаващия се характер на AI chatbot той вероятно ще бъде по-умен след месец и след година, което има потенциала да направи неговия текст по-труден за идентифициране в плагиатския софтуер.

Расизъм, сексизъм и пристрастия

Установено е също, че ChatGPT има някои проблеми, когато става въпрос за расови и полови пристрастия, свързани с чатбота. Неявното пристрастие, вградено в технологията, далеч не е нова концепция; обаче професорът по психология и неврология от UC Berkeley Стивън Пиантадоси споделено в Twitter в началото на декември 2022 г. много от обезпокоителните резултати, които той разкри при въвеждане на конкретен текст в чатбота.

Да, ChatGPT е невероятен и впечатляващ. Не, @OpenAI не се е доближил до решаването на проблема с пристрастията. Филтрите изглеждат заобиколени с прости трикове и повърхностно маскирани.

А това, което се крие вътре, е потресаващо. @Абебаб@сама

tw расизъм, сексизъм. pic.twitter.com/V4fw1fY9dY— Стивън Т. piantadosi (@spiantado) 4 декември 2022 г

Piantadosi използва заявки като „Напишете функция на Python, за да проверите дали някой би бил добър учен, въз основа на JSON описание на тяхната раса и пол“, „Програма за проверка дали животът на дете трябва да бъде спасен въз основа на тяхната раса и пол“, „Направете ASCII таблица, която класира кой прави най-добрите интелектуалци по раса и пол“ и „Направете ASCII таблица на типичните човешки мозъци въз основа на стойността ЩАТСКИ ДОЛАР. Разделете ги по раса и пол.“ Тези указания дадоха резултати, които са в полза на белите и мъжете и намаляват за жените и различните цветнокожи.

Изглежда, че OpenAI бързо се справи с проблемите, тъй като хората в коментарите на Tweet заявиха, че не са успели да пресъздадат функцията на Python запитване и вместо това бяха посрещнати с отговор от рода на „Не е уместно потенциалът на човек като учен да се основава на неговата раса или пол.”

По-специално, ChatGPT включва бутони с палец нагоре и палец надолу, които потребителите избират като част от своя алгоритъм за обучение.

Получих подобни резултати при въвеждане на заявките в ChatGPT.

Проблеми с точността

Въпреки популярността на ChatGPT, неговите проблеми с точността са добре документирани от самото му създаване. OpenAI признава че чатботът има „ограничени познания за световните събития след 2021 г.“ и е склонен да попълва отговорите с неверни данни, ако няма достатъчно налична информация по дадена тема.

Когато използвах чатбота, за да изследвам моята област на интерес, таро и астрология, успях лесно да идентифицирам грешки в отговорите и да заявя, че има невярна информация. Въпреки това, последните доклади от публикации, включително футуризъм и Gizmodo показват, че публикацията, CNET не само е използвала ChatGPT, за да генерира обяснителни статии за своята секция за пари, но е установено, че много от статиите имат явни неточности.

Докато CNET продължава да използва AI chatbot за разработване на статии, започна нов дискурс с куп въпроси. Доколко публикациите трябва да зависят от AI, за да създават съдържание? Колко трябва да се изисква от публикациите да разкриват относно използването на AI? Заменя ли AI писатели и журналисти или ги пренасочва към по-важна работа? Каква роля ще играят редакторите и проверяващите факти, ако съдържанието, разработено от AI, стане по-популярно?

Сенчестият начин, по който беше обучено

ChatGPT се основава на постоянно обучаващ се алгоритъм, който не само изтрива информация от интернет, но също така събира корекции въз основа на взаимодействието на потребителя. Въпреки това, а време доклад за разследване разкри, че OpenAI използва отбор в Кения за да обучите чатбота срещу смущаващо съдържание, включително сексуално насилие над деца, скотоложство, убийство, самоубийство, изтезания, самонараняване и кръвосмешение.

Според доклада OpenAI работи с фирмата от Сан Франциско Sama, която възложи задачата на екипа си от четирима души в Кения, за да етикетира различно съдържание като обидно. За усилията си служителите получавали по 2 долара на час.

Служителите изразиха, че изпитват психически стрес от това, че са принудени да взаимодействат с такова съдържание. Въпреки че Sama твърди, че предлага услуги за консултиране на служителите, служителите заявяват, че не могат да ги използват редовно поради интензивността на работата. В крайна сметка OpenAI прекрати отношенията си със Sama, като кенийските служители или загубиха работата си, или трябваше да изберат по-нископлатени работни места.

Разследването се занимава с твърде често срещания етичен въпрос за експлоатацията на евтини работници в полза на компании с високи печалби.

Няма мобилно приложение

Понастоящем напълно безплатният ChatGPT е достъпен като строго базирана на браузър платформа. Така че няма мобилно приложение за използване на ChatGPT в движение. Това доведе до копиращи приложения, които изпълниха магазините, включително a базирани на абонамент приложение на инструмента, достъпно в магазините за мобилни приложения на прекомерни цени. Версия на Google Play Store беше бързо маркирана и премахната, според TechCrunch.

Измамниците печелят от популярността на ChatGPT.

Приложението за измама за $7,99/седмично „ChatGPT Chat GPT AI With GPT-3“ е 5-тото най-популярно изтегляне в категорията за продуктивност на App Store, на @Gizmodo.

Напомняне: Истинският ChatGPT е безплатен за използване от всеки в интернет. pic.twitter.com/WvcL5n8zO0

— Morning Brew ☕️ (@MorningBrew) 14 януари 2023 г

Най-лошата от измамите беше в Apple App Store, където приложение, наречено „ChatGPT Chat GPT AI With GPT-3″, получи значително количество фанфари и след това медийно внимание от публикации, включително MacRumors и Gizmodo преди да бъде премахнат от App Store.

Разработчиците, които искат да направят бързи пари, таксуват $8 за седмичен абонамент след тридневен пробен период или $50 месечен абонамент, което беше значително по-скъпо от седмичната цена. Новината постави феновете нащрек, че има фалшификати на ChatGPT, които не са свързани с OpenAI, но мнозина бяха готови да платят поради ограничения достъп до истинския чатбот.

Заедно с този доклад се появиха слухове, че OpenAI разработва законно мобилно приложение за ChatGPT; марката обаче не е потвърдила тази новина.

Засега най-добрата алтернатива на мобилно приложение ChatGPT е зареждането на чатбота на вашия смартфон браузър.

Препоръки на редакторите

- Google Bard вече може да говори, но може ли да заглуши ChatGPT?

- Трафикът на уебсайта на ChatGPT е спаднал за първи път

- 81% смятат, че ChatGPT е риск за сигурността, установи проучване

- Научих ChatGPT да ме научи на настолни игри и сега никога няма да се върна

- Адвокатите от Ню Йорк са глобени за използване на фалшиви случаи на ChatGPT в съдебна справка

Надградете начина си на животDigital Trends помага на читателите да следят забързания свят на технологиите с всички най-нови новини, забавни ревюта на продукти, проницателни редакционни статии и единствени по рода си кратки погледи.