الاخبار الجيدة؟ لا يزالون غير معروفين للغالبية العظمى من الناس. الأخبار السيئة؟ إنهم لا يخدعون علوم الكمبيوتر الحديثة.

مقاطع الفيديو الموصى بها

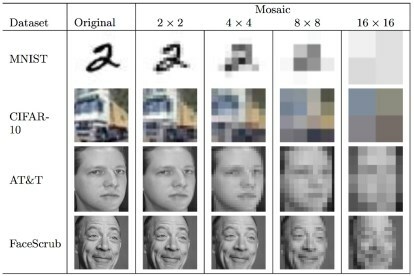

وتأتي تلك المعلومات وفقا لمشروع جديد نفذه باحثون في جامعة تكساس في أوستن وجامعة كورنيل، والذي استخدم تعلم عميق ل تخمين الهويات المنقحة بشكل صحيح من الناس المخفيين عن طريق التشويش. وبينما قام الإنسان بتخمين الهويات المنقحة بشكل صحيح بنسبة 0.19% من الوقت، كان نظام التعلم الآلي قادرًا على إصدار حكم صحيح بدقة 83%، عندما سمح له بخمس محاولات.

"غالبًا ما يتم استخدام التمويه والتقطيع لإخفاء هويات الأشخاص في الصور ومقاطع الفيديو" فيتالي شماتيكوف، أستاذ علوم الكمبيوتر في جامعة كورنيل، قال لـ Digital Trends. "في العديد من هذه السيناريوهات، يكون لدى الخصم فكرة جيدة عن مجموعة صغيرة من الأشخاص المحتملين من كان من الممكن أن يظهر في الصورة، ويحتاج فقط إلى معرفة أي منهم موجود في الصورة صورة."

وتابع شماتيكوف أن هذا هو بالضبط السيناريو الذي تعمل فيه تكنولوجيا الفريق بشكل جيد. وقال: "يظهر هذا أن التمويه والتقطيع وأساليب التعتيم الأخرى للصورة قد لا توفر الكثير من الحماية عندما يؤدي الكشف عن هوية شخص ما إلى تعريضه للخطر".

التحدي، بطبيعة الحال، هو أنه في كثير من الأحيان يتم استخدام مثل هذه الأساليب لحجب هوية الشخص لحماية شخص ما، مثل المبلغين عن المخالفات أو الشهود على جريمة. من خلال تطبيق خوارزميات التعرف على الصور، بناءً على الشبكات العصبية الاصطناعيةبالنسبة للصور التي تم حجبها باستخدام أدوات جاهزة، فمن المحتمل أن يتعرض الأشخاص للأذى.

وقال شماتيكوف: "إن التحدي الأساسي هو سد الفجوة بين تقنيات حماية الخصوصية والتعلم الآلي". "لا يقدر العديد من مصممي تقنيات الخصوصية بشكل كامل قوة التعلم الآلي الحديث - وهذا يؤدي إلى تقنيات لا تحمي الخصوصية فعليًا."

توصيات المحررين

- لا تدفع ضريبة Verizon 5G مقابل Google Pixel 4a 5G

- لا تتكلم: يتيح لك هذا الجهاز القابل للارتداء إعطاء أوامر صوتية دون أن تنطق بكلمة واحدة

- لا تنخدع، فهذا النظام الآلي يتلاعب بمحتوى الفيديو بشكل خفي

ترقية نمط حياتكتساعد الاتجاهات الرقمية القراء على متابعة عالم التكنولوجيا سريع الخطى من خلال أحدث الأخبار ومراجعات المنتجات الممتعة والمقالات الافتتاحية الثاقبة ونظرات خاطفة فريدة من نوعها.